-

Compteur de contenus

9 111 -

Inscription

-

Dernière visite

-

Jours gagnés

79

Type de contenu

Profils

Forums

Téléchargements

Blogs

Boutique

Calendrier

Noctua

Tout ce qui a été posté par Colmic

-

[Teasing] : contrôle du tilt dans Siril !

Colmic a répondu à un sujet de Colmic dans Logiciel SIRIL de Siril et Sirilic

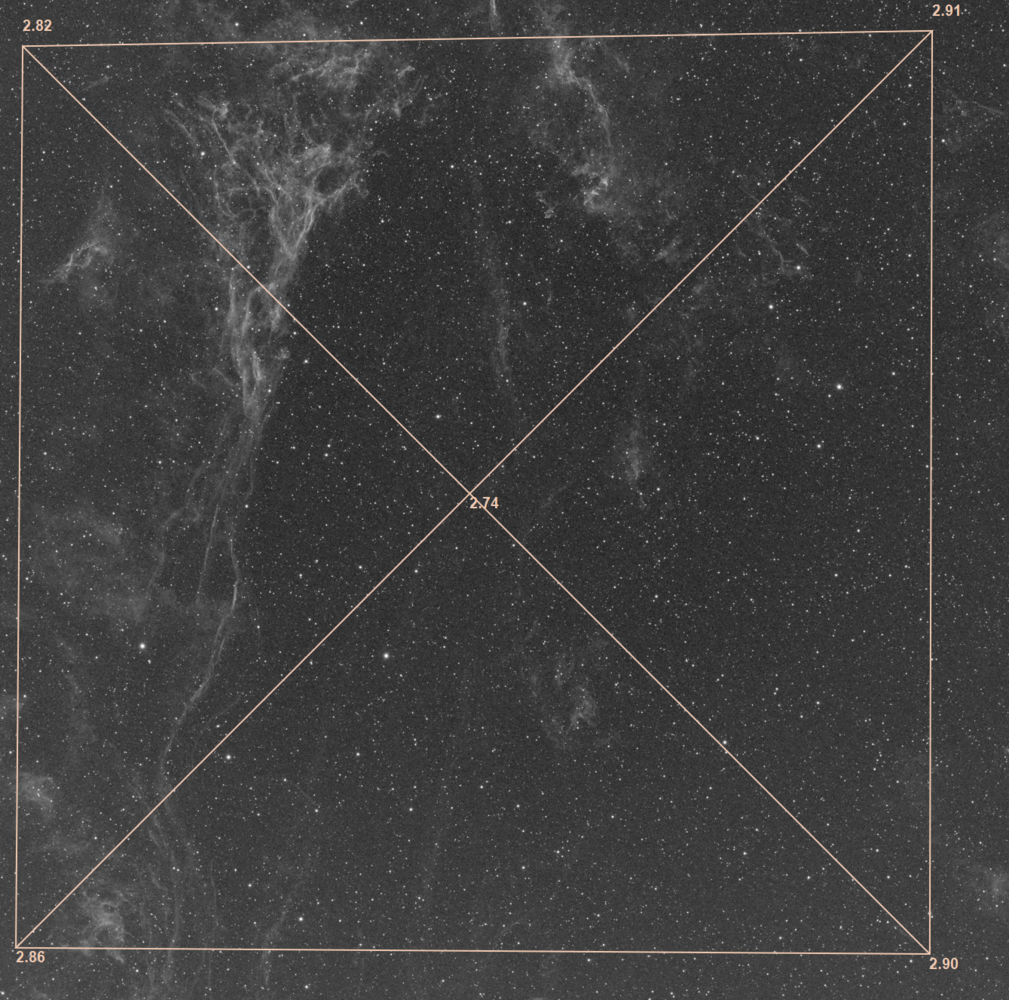

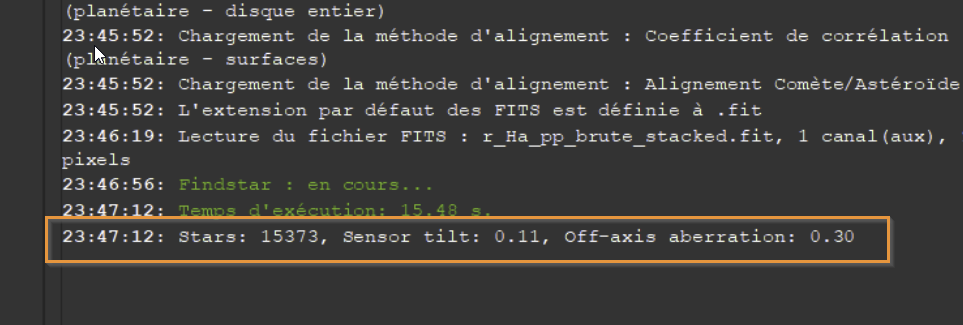

Impossible de se faire une idée de quel angle est plus éloigné et lequel est plus proche. Comme le dit Cyril, ça donne juste une indication. On peut s'en servir pour savoir s'il est nécessaire de corriger le tilt, mais pour le régler il existe une méthode simple expliquée ici : https://aiastro.wordpress.com/2019/01/24/sensor-tilt-adjustment/ Test effectué avec la dernière version de Cyril (avec la valeur au centre) : Pour un capteur full-frame et des pixels de 3.76µ et à F/5, je m'en tire pas si mal -

[Teasing] : contrôle du tilt dans Siril !

Colmic a répondu à un sujet de Colmic dans Logiciel SIRIL de Siril et Sirilic

Si on avait une fonction comme ça qui corrige la déformation des étoiles, ça serait le graal Mais faut pas trop rêver ! -

APN + Filtre multibande / Camera CCD + SHO/HOO

Colmic a répondu à un sujet de John.Yeah dans Astrophotographie

Sous mon post. Si tu ne la vois pas c'est que tu dois lire et répondre sur smartphone peut-être ? Mes TUTOS : Traitement complet d'une image Ciel Profond avec les scripts SIRIL Tout savoir sur les filtres multi-bandes en astrophoto Calculs, règles et généralités autour des CMOS Tout sur ASiair / ASiair pro De la prise de vue au peaufinage d'une mosaïque solaire Créer une animation solaire Règle à calcul pour l'imagerie solaire -

[Teasing] : contrôle du tilt dans Siril !

un sujet a posté Colmic dans Logiciel SIRIL de Siril et Sirilic

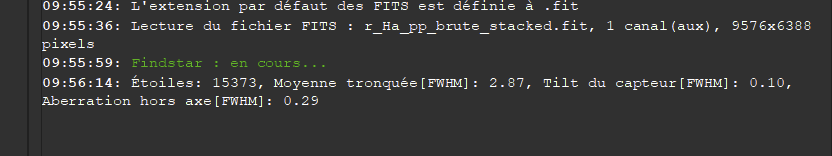

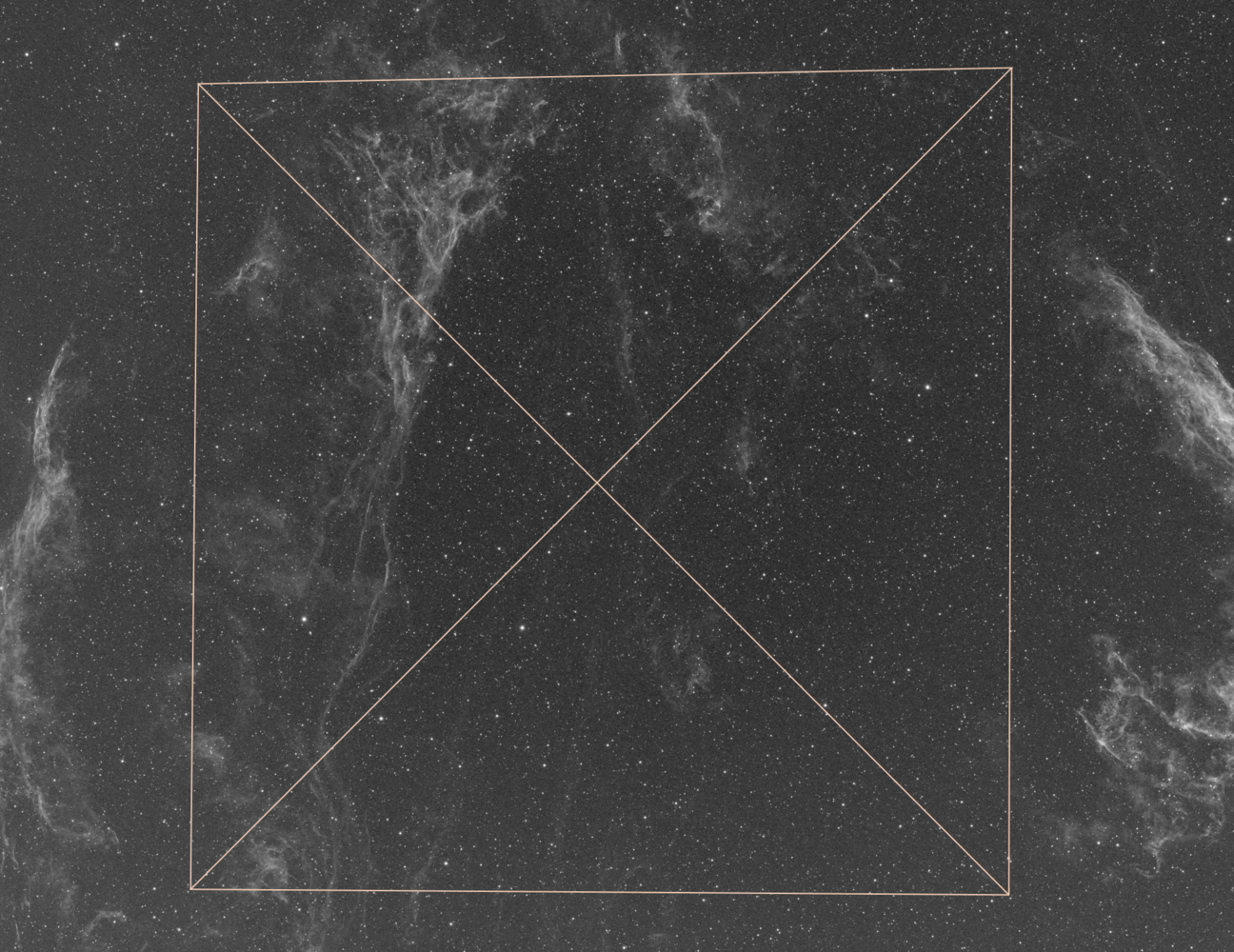

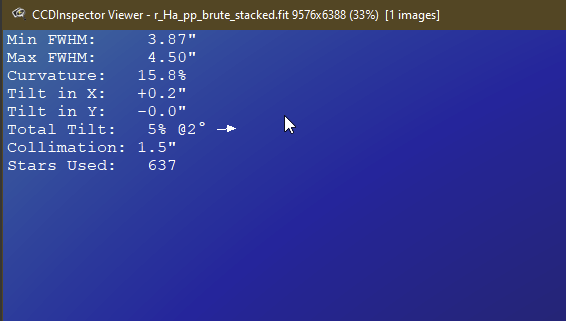

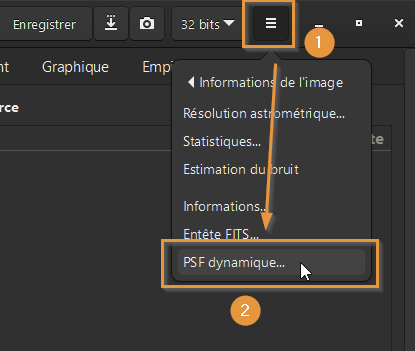

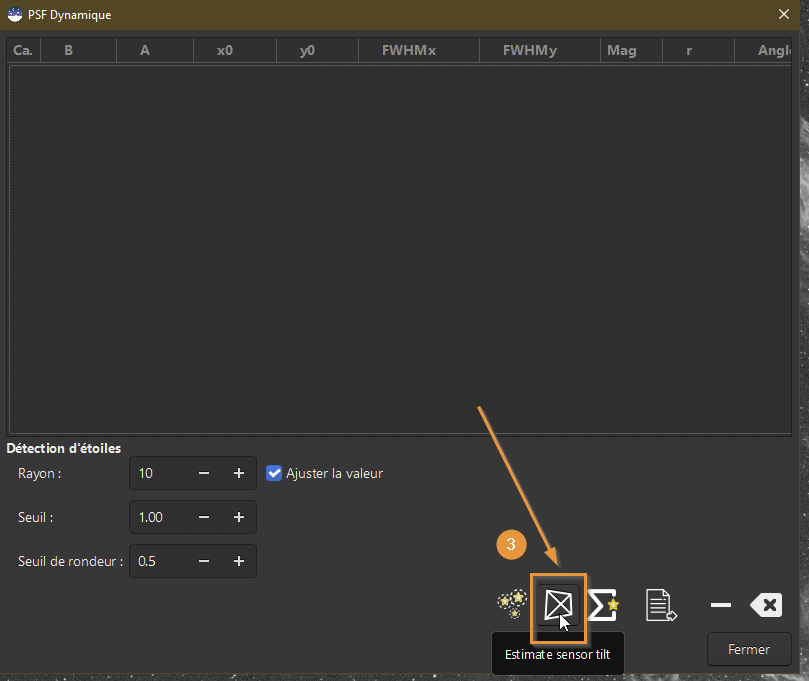

Salut à tous, A ma demande, Cyril vient d'implémenter un outil d'analyse du tilt de l'image chargée. Un grand merci à lui, j'en avais un peu marre des temps de réponse énorme d'ASTAP uniquement pour faire ça ! Dorénavant, on aura tout dans le même outil Sera intégré dans la prochaine version. Quelques copies d'écran du proto : Pour comparaison ASTAP sur la même image (avec un temps de chargement de l'image extrêmement long) : Pour comparaison, CCDInspector : -

APN + Filtre multibande / Camera CCD + SHO/HOO

Colmic a répondu à un sujet de John.Yeah dans Astrophotographie

Salut, dans mon tuto SiriL (en signature) je parle du traitement avec extaction HaOIII dans les chapitres 4 et 5. Tu as également les brutes à disposition pour t'entrainer. Les filtres Baader et Astronomik ne sont dispo que pour les caméras mono. Concernant les filtres multibandes pour caméras/APN couleur, voir en bas de mon article sur les filtres (toujours en signature). Je rebondis sur ceci : Non la résolution n'est pas divisée par 4 avec une caméra couleur. Je donne les chiffres exacts dans mon article sur les filtres : Donc au pire la résolution est divisée par 2. -

(Topic unique) Tout sur ASiair / ASiair Pro / ASiair Plus

Colmic a répondu à un sujet de Colmic dans Astrophotographie

J'ai une solution : - il faut que le Wi-Fi de ta box porte jusque dans le jardin, soit nativement, soit à l'aide d'un extender Wi-Fi (genre une antenne outdoor) - tu te connectes au Wi-Fi de l'Asiair - dans les options Wi-Fi de l'ASiair tu passes en 2.4Ghz - dans les options Wi-Fi de l'ASiair tu passes en mode Wi-Fi station mode puis tu sélectionnes le Wi-Fi de ta box Tu auras alors accès au Wi-Fi de l'ASiair et tu pourras aller sur internet. -

Ma dernière photo avant les vacances : la nébuleuse du sorcier

Colmic a répondu à un sujet de Guy53 dans Astrophotographie

Oui Guy tes images s'améliorent à vitesse grand V ! Bravo elle est très sympa celle-ci. Les étoiles sont rondes, c'est cool. -

APN + Filtre multibande / Camera CCD + SHO/HOO

Colmic a répondu à un sujet de John.Yeah dans Astrophotographie

Ben tout dépend des cibles que tu privilégies. Je comprends qu'avec une 80Ed tu vas vouloir t'orienter en priorité vers du grand champ, typiquement des nébuleuses. Dans un budget de 1000 euros, je dirais soit l'ASI533MC soit l'ASI294MC. Si tu optes pour une caméra mono, tu rajoutes a minima un billet de 500 pour la roue et les filtres. En restant sur une caméra couleur, tu rajoutes 200 euros dans un bon filtre multibandes (voir mon article sur les filtres en signature). Le narrowband (ça peut être du SHO ou du HOO) est bien plus simple à réaliser et à traiter sur une caméra couleur, notamment avec les scripts d'extraction HaOIII de SiriL. Les résultats s'approchent d'une cam mono sans l'emmerdement. Dans un budget de 2000 euros, en caméra couleur, l'ASI2600MC met tout le monde d'accord. En restant sur une cam mono, il n'y a guère de choix : ASI294MM, ASI183MM ou ASI2600MM en fonction du budget (dans le cas de la 2600MM on dépasse les 3000 euros en comptant la roue et les filtres). Sinon une ASI1600 d'occasion fait encore le job. -

Le sorcier stellaire à chaud ! NGC 7380 en HOO

Colmic a répondu à un sujet de LucaR dans Astrophotographie

J'ai habité 10 ans à Aincourt dans les années 2000, à 2kms d'Enfer. On se retrouvait à l'époque avec Avex et d'autres clubs de la RP ouest. Puis on a migré vers Breuil et Parnes car Enfer devenait de plus en plus lumineux au fil des années. Vaudancourt est un très beau spot où on peut accueillir facilement 20 personnes avec voitures et télescopes, et on a l'aval de la mairie. Bon ça fait quand même une heure pour moi maintenant qui habite sur Enghien, donc j'y vais vraiment quand je suis certain de la météo et par une nuit sans Lune Oui pour commencer. Ensuite il faut ajuster les couleurs (surtout pas par photométrie, l'autre), puis suppression du bruit vert, tu vas alors récupérer du bleu dans le OIII avec une impression de SHO. Voir mon topic : -

Le sorcier stellaire à chaud ! NGC 7380 en HOO

Colmic a répondu à un sujet de LucaR dans Astrophotographie

Oui le ciel est plutôt pas mauvais, sauf bien évidemment le sud (vallée de la Seine) et l'Est (Paris). Disons que si on reste au zénith et à l'ouest nord-ouest ça va. La turbu y est particulièrement faible, on a des souvenirs en planétaire assez fantastiques. Ca fait une heure de chez moi également. Sinon on a aussi 2 spots sur Breuil et un sur Enfer quand on a la flemme de faire trop de kms -

Le sorcier stellaire à chaud ! NGC 7380 en HOO

Colmic a répondu à un sujet de LucaR dans Astrophotographie

Tu observes dans le Vexin ? Dans quel coin ? Nous on se réunit régulièrement sur Vaudancourt. Ca se serait cool de s'y retrouver un soir. Pour l'image, bel essai, sympa à regarder. Tente un HHO pour voir... -

APN + Filtre multibande / Camera CCD + SHO/HOO

Colmic a répondu à un sujet de John.Yeah dans Astrophotographie

Trop vague comme question. Sur quelle optique ? Quel F/D ? Quel budget ? Quelles cibles en priorité ? Mono, couleur RVB, narrowband ? Comment est ton ciel ? -

Reprise de l'Astrophoto !

Colmic a répondu à un sujet de remy gallet dans Matériel astrophotographique

J'en parle en détail dans mon article sur les filtres multibandes justement (lien dans ma signature). SiriL dispose de 2 scripts spécifiques pour le traitement couleur avec extraction des couches Ha et OIII, j'en parle dans mon tuto numéro 5 SiriL (lien également en signature). Pour revenir à la question initiale, oui les EDPH sont pas mal du tout, ainsi que les SDQ (Petzval). Côté caméras, la série des 533/2600/6200 est très intéressante, selon ton budget. La 2600 est la digne remplaçante de la 1600 qui devient un peu obsolète. La 183 mono est très bien pour les petites focales également, éviter le modèle couleur pas assez sensible. Sinon la 294 couleur ou mono est également intéressante. Et pour l'autoguidage, l'ASI290 met tout le monde d'accord. Elle existe en version mini spécial autoguidage. Voilà quelques exemples de ce que tu peux obtenir en RP avec une caméra couleur + filtre L-Extrême d'Optolong : Et pour l'alimentation : -

Quand je vois la somme d'énergie déployée par vous tous pour tenter de convaincre (ou pas) seulement 2 récalcitrants (Snake et Albéric), si vous vous emmerdez chez vous je vous invite à la maison pour m'aider à finir mes travaux En contre-partie je vous offre le barbeque et une soirée d'observation

-

SH2-129 Flying Bat Nebula HOO - 61 EDPH II et ASI 2600MC avec L-eXtreme

Colmic a répondu à un sujet de Siolan dans Astrophotographie

Pour le coup tu t'es attaqué au K2 avant de passer le Mont Blanc Le Calamar est très difficile même pour quelqu'un d'expérimenté et de très bien équipé Mais c'est bien de l'avoir tenté, ça te donne une idée des difficultés. C'était chez mon pote en Vendée sous un ciel plus sombre que la Drôme sans l'altitude. Avec la FSQ + réducteur F/3.6 oui. -

Sincèrement... Vous me fatiguez Votre débat tourne en rond depuis des semaines, mais si vous avez besoin de vous défouler derrière un écran pour vous sentir vivants, allez-y.

-

SH2-129 Flying Bat Nebula HOO - 61 EDPH II et ASI 2600MC avec L-eXtreme

Colmic a répondu à un sujet de Siolan dans Astrophotographie

Salut, pratiquement aucune chance que tu sortes le Calamar avec des poses de seulement 120s à F/4.5. Le temps de pose total sert surtout à augmenter le RSB et donc à pouvoir tirer sur les curseurs. Encore faut-il que l'information soit présente sur tes brutes unitaires ! Avec le L-Extrême, il faut à mon sens pas moins de 180s de pose unitaire pour des objets lumineux, et au moins 300s pour des objets diffus, surtout s'ils n'apparaissent qu'en OIII. Voici ce que j'ai sorti à F/3.6 et des poses unitaires de 300s (42x300s) sous un excellent ciel, c'est pas bien violent non plus : -

(Topic unique) Tout savoir sur les filtres multi-bandes en astrophoto

Colmic a répondu à un sujet de Colmic dans Matériel astrophotographique

Tu t'en fous du H-béta, il est non-représentatif en regard du pourcentage de Ha, de SII et de OIII. Justement, si la couche OIII est plus bruitée, autant en récupérer le plus possible pour faire baisser le bruit. Du coup il vaut mieux un SII+OIII plutôt qu'un SII seul qui ne va te donner que du rouge sur ta caméra couleur, donc en gros 1 pixel utile et 3 pixels de perdus. Tu lances le script extraction_Ha sur ta première session (avec le SII). Tu vas récupérer une image Resultat_Ha que tu renommes Resultat_SII. Tu lances ensuite le script extraction_HaOIII sur ta seconde session (avec le Enhance). Tu vas récupérer cette fois 1 images Resultat_Ha et Resultat_OIII. Tu réalignes enfin en manuel les 3 images Ha, OIII, SII entre elles. Composition RVB avec R=SII, V=Ha, B=OIII. -

NGC 7000 North America Nebula - 61 EDPH II et ASI 2600MC avec L-eXtreme

Colmic a répondu à un sujet de Siolan dans Astrophotographie

Le temps le dira... T'avais tout à fait le droit de réagir et de dire que tu n'aimes pas ces couleurs. Il n'y avait aucun trucage de l'image, c'est du HHO pur et c'est comme ça que ça sort en HHO de SiriL, contrairement au HOO. Il n'y a même aucune saturation des couleurs. Le HOO pur sur NGC7000 est à mon sens moins esthétique que du RVB, c'est tout rouge de partout, c'est pour ça que la plupart des astrams font du SHO sur cet objet en particulier, de même que sur la trompe d'éléphant par exemple. Maintenant si j'ai réagi c'est au terme "égout". Ce jeu de mot ne me fait pas particulièrement plaisir, je ne crois pas t'avoir jamais manqué de respect de mon côté. -

Tech Script Ha OIII - comment rajouter une composante SII?

Colmic a répondu à un sujet de Ddaniel84 dans Aide SIRIL de Siril et Sirilic

Je suis pas certain que le résultat soit cohérent mais si tu dis que c'est équilibré. T'as une image à montrer ? C'est pas ainsi que je procèderais personnellement. - script extraction HaOIII pour la première série (dual band) => tu vas récupérer un fichier Ha_resultat et un autre OIII_resultat. - script extraction Ha pour la seconde série (SII) => tu vas récupérer un fichier Ha_resultat que tu renommes SII_Resultat. - en manuel cette fois, tu réalignes les 3 images entre elles. - Compo RVB => SII en R, Ha en V, OIII en B -

Filtres Idas LB2 et LB3

Colmic a répondu à un sujet de Petitprost dans Aide SIRIL de Siril et Sirilic

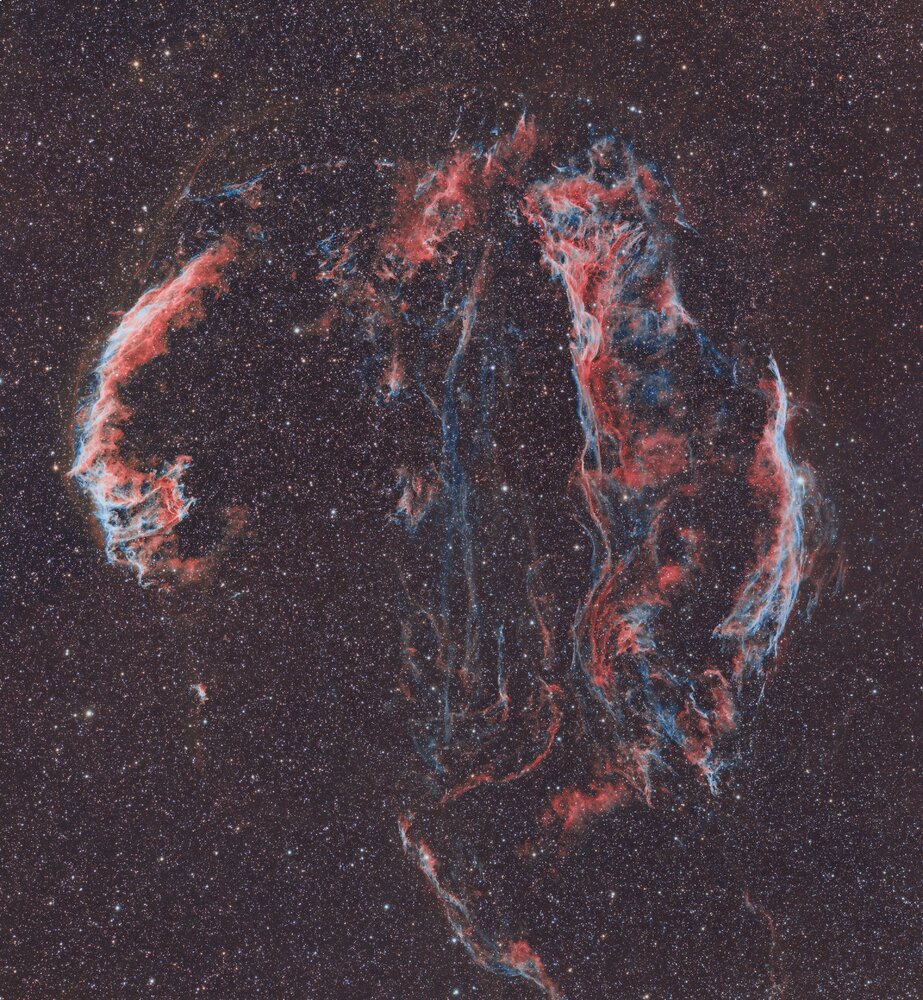

Faut bien comprendre comment ça fonctionne La caméra elle s'en fout que ça soit du Ha ou du SII, dans les 2 cas elle va voir... du rouge ! Du coup au traitement avec extraction HaOIII, tu vas extraire un rouge qui sera le Ha dans le cas où t'as mis le filtre Ha devant, et dans l'autre cas tu vas extraire un autre rouge qui sera du SII dans le cas où t'as mis le filtre SII devant. Ta première extraction Ha (avec le filtre Ha) elle s'appellera Ha_resultat, tu la renommes en Couche_Ha. Ta seconde extraction Ha (avec le filtre SII) elle s'appellera aussi Ha_resultat et tu la renommes en Couche_SII. A la composition RVB, tu colles Couche_Ha dans le vert, et Couche_SII dans le rouge, et enfin Couche_OIII dans le bleu. Un exemple de mosaïque sur les dentelles avec le L-extrême + L-Pro : traitement sous SiriL puis construction de la mosaïque avec l'outil Photomerge de Photoshop, tout à la fin. -

NGC 7000 North America Nebula - 61 EDPH II et ASI 2600MC avec L-eXtreme

Colmic a répondu à un sujet de Siolan dans Astrophotographie

Merci pour ton passage tout en finesse... Que tu n'aimes pas c'est ton droit le plus strict, que tu manques de respect c'est plus que limite en revanche. Et sinon pas de remarque sur l'image de l'OP ? -

IC1396 - Nébuleuse de la Trompe d'éléphant

Colmic a répondu à un sujet de Astorm dans Astrophotographie

Il tient qu'à toi de faire des propals aux devs Si tu avais vu ce que c'était il y a 2 ans, là oui t'aurais pu râler ! Maintenant si tu veux absolument rester sur DSS, libre à toi, mais tu risques de stagner niveau résultat. C'est toujours le cas. Si tu filtres une étoile bleue avec un filtre rouge, son signal sera fortement atténué. si tu filtres une étoile jaune avec un filtre bleu, son signal sera fortement atténué. Maintenant si tu filtres une étoile bleue avec un filtre bleu, ben elle est sublimée et son signal sera plein pot. Moi je vois 3 vignetages sombres, le R est juste moins sombre que les 2 autres, certainement dû à un flat fait différemment ou pas dans les mêmes conditions. -

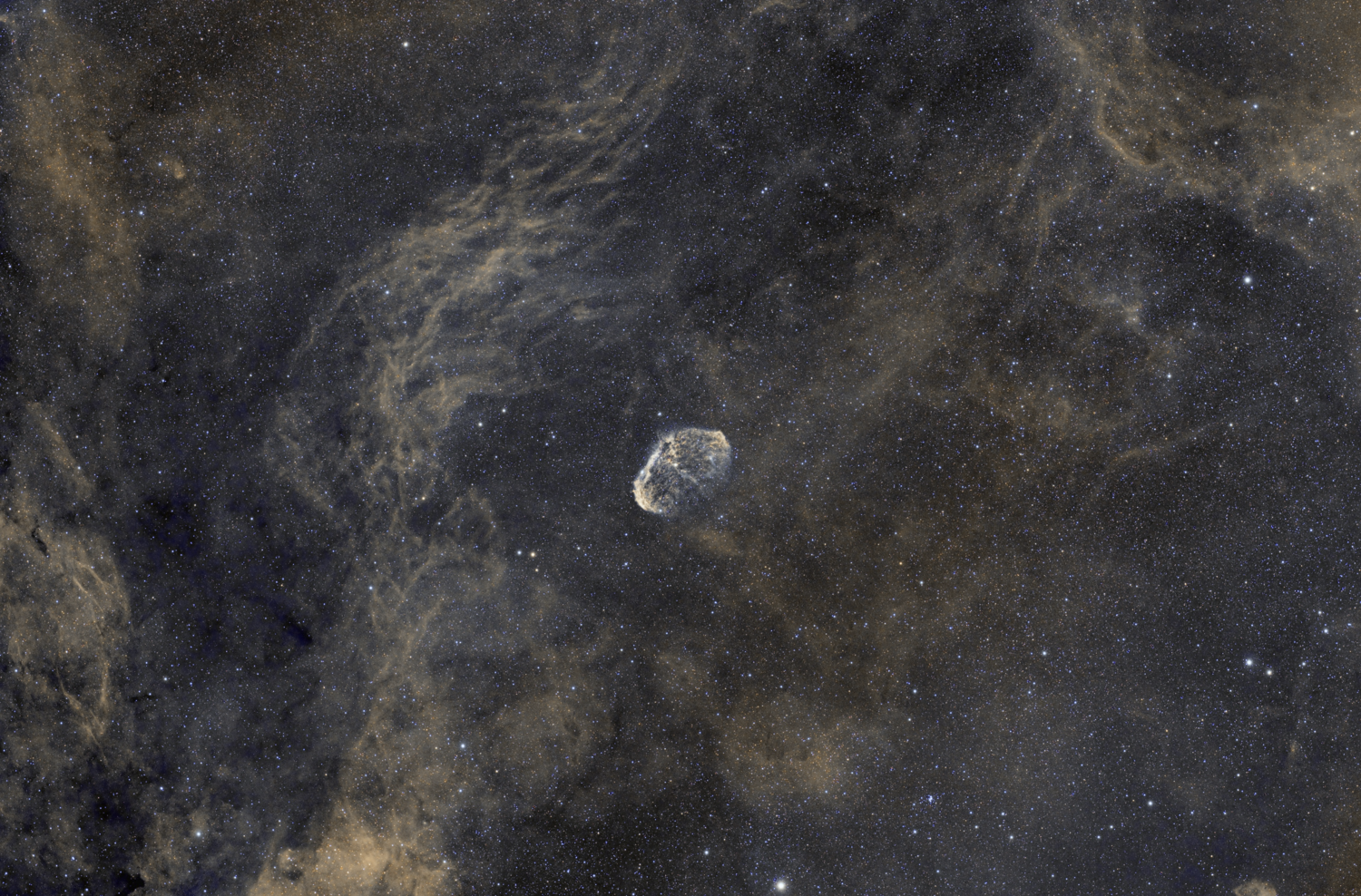

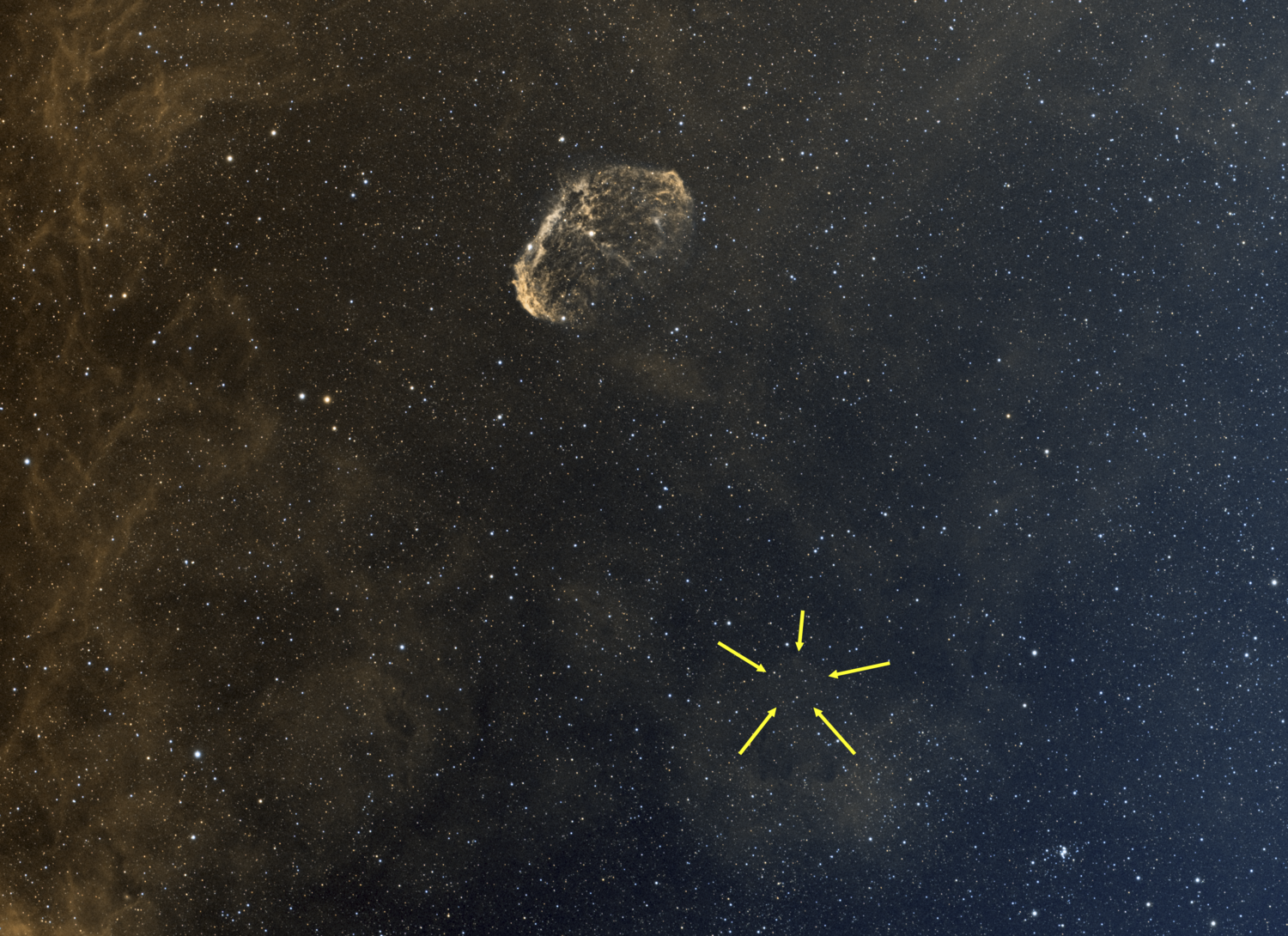

Bonjour tout le monde Oui un croissant de l'Extrême ! Jugez plutôt : - nous sommes le 24 juin, soit 3 jours après le solstice d'été, sans nuit astronomique - cette image a été prise à 3km du périph nord parisien, à 12km de Notre Dame - ce soir c'est la pleine Lune !! Qu'à cela ne tienne, il fait beau ce soir après toute cette pluie qu'on s'est pris depuis une semaine, et il faut que je teste mon nouvel EAF (modèle sans alim 12V). Bon il n'y avait pas grand chose à attendre d'une telle soirée en terme de résultat, mais je vous la montre quand même - FSQ106 à F/5 sur EM200 Temma2 - ASI6200MC à -10°C + filtre Optolong L-Extrême - Guidage par ASI290 mini sur OAG M68 de ZWO - Le tout piloté par l'ASiair pro et alimenté par la Boîte-Accus-contrepoids - 54 poses de 180s, gain 100, traité sous SiriL puis finition sous CS5 La HHO : Et un zoom sur la nébuleuse et la bulle de savon qui, à ma grande surprise compte-tenu des conditions, apparaît quand même un peu !

-

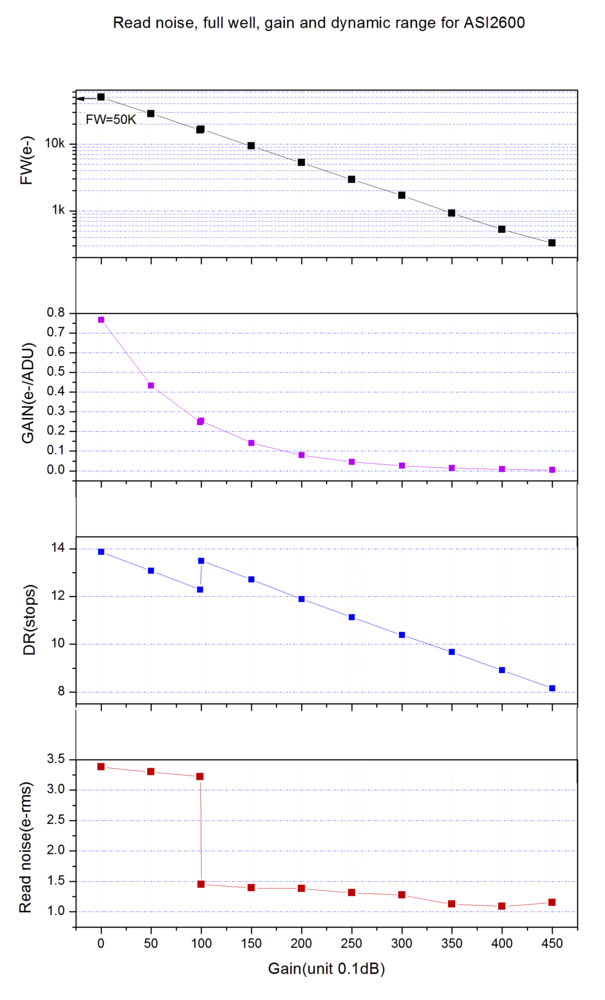

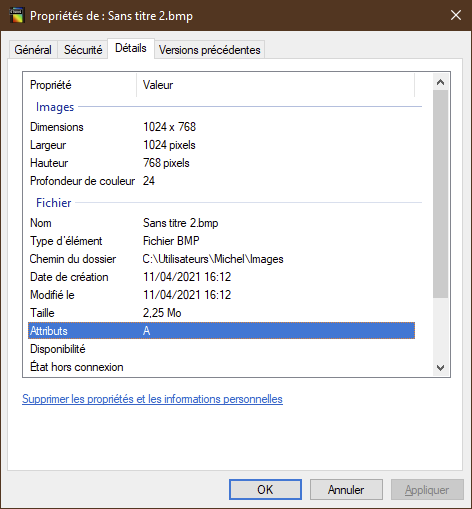

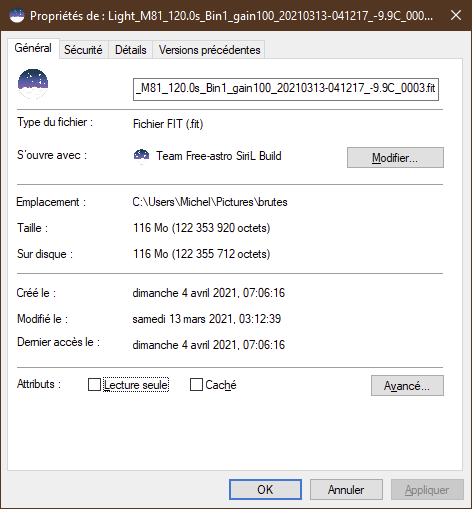

Bonjour à tous, comme je vois passer régulièrement les mêmes questions autour des CMOS (caméras et APN), j'ai décidé de créer un nouveau topic unique qui permettrait de répondre à toutes vos interrogations. On centralisera ainsi toutes les règles, les bonnes pratiques, etc.. sur le même topic. Nous aborderons ainsi les sujets suivants : Petit aparté concernant les calculs numériques Empilement et dynamique Comment analyser le graphe d'un capteur Déterminer son temps de pose ou règle des 3 sigma DARKS, FLATS, BIAS (OFFSETS) et DITHERING Calcul de l'échantillonnage idéal avec un CMOS Petit aparté concernant les calculs numériques Notions de calcul binaire Nous travaillons ici en binaire, c'est à dire que l'électricité qui passe dans un fil (ou un bit) ne peut avoir que 2 états : état 0 éteint et état 1 allumé. Si nous travaillons cette fois sur 8 fils en parallèle (8 bits), nous pouvons obtenir 2 puissance 8 = 256 états différents (entre 0 et 255). Enfin si nous travaillons sur 16 fils (16 bits), nous pouvons obtenir 2 puissance 16 = 65536 états différents (entre 0 et 65535). Nous obtenons ainsi différentes puissances de 2, à savoir 2, 4 , 8, 16, 32, 64, 128, 256, 512, 1024, 2048, 4096, 8192, 16384, 32768 et 65536. Toute l'informatique repose sur ces notions et il est intéressant de les connaître pour bien assimiler son fonctionnement. Les octets Ainsi quand on parle d'octet, cela correspond à 8 bits (octo : 8 ). Attention également, en anglais octet se prononce Byte, donc 1 Byte = 8 bits (1B = 8b). Avec 256 états différents, il est ainsi possible de coder tout l'alphabet avec des caractères spéciaux, des symboles etc... L'invention de la table de caractères ASCII a permis de développer un langage informatique (cette table de caractères a depuis été remplacée par la table ANSI ou Unicode sous Windows). Par exemple, la lettre A possède le code ASCII 65 ce qui en binaire correspond à 0100 0001 ou encore 41 en hexadécimal. Ainsi, l'octet est devenu la base de toute l'informatique. Par exemple, le texte brut contenu sur une feuille A4 peut être codé sur seulement 2000 octets environ (2 kilo-octet ou 2ko), soit environ 400ko seulement pour un livre de 200 pages ! Poids d'une image en octets Pour une image en 16 millions de couleurs, un pixel peut être codé sur 3 octets seulement (1 octet pour chaque couche R, V, B), soit 256 puissance 3 =16 777 216. Une image BMP non compressée de 1024 x 768 pèsera alors exactement 1024 x 768 x 3 = 2.359.296 octets, soit 2.25 Mégaoctets* (2.25Mo) : En revanche une image FIT (par définition non compressée et codée sur 16 bits) issue d'une ASI6200MC de 62 millions de pixels pèsera environ 116Mo. En effet, avec 9576 x 6388 x 2 = 122.353.920 octets ou encore 116Mo (un pixel est codé sur 2 octets pour arriver à 16 bits) : * A noter qu'un Mégaoctet vu par l'ordinateur ne représente pas 1.000.000 (soit 10 puissance 6) mais 1.048.576 octets (soit 2 puissance 20). C'est pour cette raison que 2.359.296 / 1.048.576 = 2.25Mo et pas 2.36Mo. Merci à @keymlinux pour le complément d'explication suivant : Débits et vitesse de connexion Si on parle d'une connexion de 100Megabits par seconde, nous obtenons une vitesse de 10 Méga-octets par seconde environ (8 bits + des bits de contrôle). Idem quand on parle de Gigabits, 1 Gigabit/s équivaut à 100Mo/s (100 Méga-octets par seconde). Il faut donc faire très attention aux symboles utilisés. 100MB/s en anglais correspond à 100 Méga-octets par seconde quand 100Mb/s correspond à 100 Mégabits par seconde. Avec une connexion fibre de 1Gb/s, en théorie on pourrait ainsi transférer une image FIT de 120Mo (issue d'une ASI6200) en moins de 2 secondes ! Empilement et dynamique Quand on empile 4 fois plus d'images, on obtient 1 bit de dynamique en plus. Ainsi on gagne 2 bits pour 16 images empilées, 3 bits pour 64, 4 bits pour 256 images, etc.. Il est intéressant de connaître cette notion, car si on perd 2 bits (ou 2 stops) en montant de 400 à 800 ISO par exemple, alors il faudra empiler 16 fois plus d'images à 800 ISO pour avoir la même dynamique qu'à 400 ISO. De même, avec une caméra 12 bits on devra empiler 16 fois plus d'images qu'une caméra 14 bits pour obtenir la même dynamique, et 256 fois plus qu'une caméra 16 bits ! Une grande dynamique d'image permet de faire ressortir les faibles extensions sans cramer le cœur d'une galaxie par exemple, mais aussi d'obtenir des dégradés de gris ou de couleurs plus riches. Comment analyser le graphe d'un capteur ? Nous allons d'abord voir les différentes notions qui vont nous permettre d'analyser correctement et simplement (sans trop de formules compliquées) les différentes valeurs dans les graphes mis à disposition des constructeurs. Pour cela nous allons avoir besoin de connaître le fonctionnement d'une caméra ou d'un APN. FW : Full Well Un capteur CMOS contient un certain nombre de pixels, composés de puits de potentiel qui vont, comme un entonnoir qui recueille de l'eau de pluie, recueillir les photons qui arrivent sur le capteur, les transformer en électrons, et les convertir en unités numériques (ADU) à l'aide d'un convertisseur Analogique/Digital (ADC). Ces entonnoirs ne sont pas infinis, c'est à dire que quand l'entonnoir déborde, le pixel est dit "saturé". La capacité de ces entonnoirs à photons est donnée par le premier graphe, à savoir le FW ou Full Well, ou encore la capacité des puits de potentiel des pixels. Une fois les électrons convertis numériquement, nous obtenons une valeur en ADU. Le convertisseur (ADC) est généralement donné sur un nombre de bits, entre 8 et 16 avec une capacité en ADU entre 256 (8 bits) et 65536 (16 bits). GAIN Le second graphe nous donne généralement le GAIN, à savoir combien d'électrons sont convertis en ADU pour un gain donné. GAIN et gain ne sont donc pas la même chose. le GAIN s'exprime en électrons par ADU (e-/ADU) alors que le gain n'est qu'une amplification du signal reçu (de la même façon qu'on retrouve les ISO sur les APN) et s'exprime en décibels (échelle 0.1dB sur les graphes). Ainsi pour une amplification donnée de xx décibels, le GAIN en électron par ADU évoluera. Une valeur intéressante de ce graphe du GAIN se situe quand 1 électron = 1 ADU, on appelle ceci le gain unitaire et c'est généralement la valeur qu'on va utiliser le plus souvent pour faire nos images, avec un bon compromis entre le bruit et la dynamique. DR : Dynamic Range Le 3ème graphe va nous montrer la courbe de la dynamique du capteur (DR ou dynamic Range) en nombre de stops (ou en bits), comparable à un APN. Cette dynamique est maximale au gain 0 et va décroître régulièrement si on monte le gain. Une dynamique de 16 bits va nous permettre d'avoir 65536 niveaux de gris ou de couleurs sur chaque pixel, quand une dynamique de 8 bits ne nous donnera plus que 256 niveaux de gris ou de couleurs possibles. Read Noise Enfin le dernier graphe nous donnera le bruit de lecture de la caméra, ou le Read Noise, en électrons. Le bruit de lecture dépend du capteur mais aussi du gain utilisé. Plus le gain est élevé, plus le bruit de lecture va baisser dans une certaine mesure pour finir par stagner. Prenons maintenant 2 exemples concrets et analysons-les. EXEMPLE 1 : ASI183MM Comment analyser cette caméra ? Tout d'abord nous voyons dans le premier graphe, que la capacité des puits de potentiels est de 15.000 électrons environ à gain 0. Pour convertir ces 15.000 électrons en ADU au gain 0 on voit sur le second graphe que le GAIN est de 3.6 environ. 3.6 = 15.000 / ADU donc ADU = 15.000 / 3.6 ce qui nous donne environ 4166 ADU pour 15.000 électrons. En numérique, la valeur la plus proche de 4166 est 4096, soit 2 puissance 12 en binaire ou encore 12 bits. Il est donc inutile d'utiliser un ADC supérieur à 12 bits avec cette caméra, puisque les puits de potentiel ne vont que jusqu'à 4096 ADU. Sur le second graphe, on voit que le gain unitaire (pour rappel l'endroit sur le graphe où 1 électron = 1 ADU) se situe au gain 120 (soit 12dB d'amplification).* A ce gain, la dynamique est de 11 bits environ et le bruit de lecture a bien chûté de 3.0e- à environ 2.2e-. C'est à ce gain qu'on fera la plupart de nos images. Travailler à un gain inférieur nous donnera une plus grande capacité des puits de potentiel, donc un risque de saturation moins élevé. Travailler à un gain supérieur nous donnera un bruit de lecture plus faible, mais une dynamique plus faible et une saturation qui arrivera plus rapidement. * Sur d'autres graphes ou mesures réalisées, on note un gain unitaire de 111 et non pas 120. Sur l'ASiair par exemple, ce gain unitaire est bien paramétré à 111. A noter que plus on monte le gain plus on réduit la dynamique du capteur. On voit que la courbe du bruit de lecture s'infléchit vers 200 de gain et le bruit ne descend plus beaucoup ensuite. A 300 de gain (soit 30dB d’amplification !), on n'a plus que 8 bits de dynamique pour 1.5e- de bruit de lecture, et il ne reste plus qu'une capacité de 400 électrons dans les puits de potentiel, la saturation des pixels intervient très rapidement. Monter le gain sur ce type de capteur peut toutefois être intéressant quand on travaille en narrowband (avec filtres SHO) car la perte de lumière due aux filtres est importante et les temps de pose unitaires deviennent très longs. Pour réduire ce temps de pose à des valeurs acceptables, on augmente alors le gain. Cela permet également de limiter l'ampglow de ce capteur (l'électroluminescence sur le côté du capteur) qui devient très difficile à retirer après 5 minutes de pose. EXEMPLE 2 : ASI2600MC Comment analyser cette caméra ? On voit dans le premier graphe que la capacité des puits de potentiel est bien plus élevée sur cette caméra que l'ASI183 du dessus. A gain 0, elle est de 50.000 électrons. Ce qui veut dire qu'elle saturera nettement moins rapidement, permettant une bonne dynamique sur les objets à fort écart de luminosité (M42, M31, etc..). Pour convertir ces 50.000 électrons en ADU au gain 0, le GAIN du second graphe est de 0.8 environ. Ce qui nous donne 50.000 / 0.8 = 62500 ADU environ. Il nous faudra cette fois un ADC de 16 bits (65536 étant la valeur la plus proche en numérique). Sur ce capteur, on voit une chute rapide du bruit de lecture qui survient à gain 100 (10dB d'amplification). Cette chute s'explique car à ce gain de 100 le capteur déclenche son boost d'ampli et passe en mode HCG (High Conversion Gain). Cet ampli va booster le gain du capteur avec pour conséquence un bruit fortement réduit tout en conservant la dynamique d'origine. Ceci est assez révolutionnaire et typique chez Sony depuis le réputé A7S qui déclenche son mode HCG à partir de 2000 ISO. Sur ce type de capteur, on ne peut pas parler de gain unitaire puisque le GAIN démarre seulement à 0.8, mais on prend alors le gain de déclenchement du mode HCG, à savoir 100 sur ce capteur. On continue l'analyse et on voit ensuite que le bruit de lecture ne descend plus au-delà du gain 100. Il est donc inutile de dépasser le gain 100 puisqu'on baisserait alors la dynamique du capteur sans réduire le bruit. Si un APN était équipé de ce capteur, on dit alors qu'il devient ISOLess à partir de l'ISO correspondant au déclenchement du mode HCG. Pour revenir au Sony A7S, il est donc particulièrement intéressant de travailler à 2000ISO mais monter plus haut en ISO ne fera rien gagner, au contraire, on perdra en dynamique. Sur ce capteur IMX571 de l'ASI2600MC, on n'a finalement que 2 gains de travail : 0 dans les cas où limiter la saturation est importante (photométrie par exemple, ou conserver la couleur des étoiles brillantes), et 100 pour tout le reste.

- 218 réponses

-

- 30

-

-