-

Compteur de contenus

1003 -

Inscription

-

Dernière visite

-

Jours gagnés

5

Type de contenu

Profils

Forums

Téléchargements

Blogs

Boutique

Calendrier

Noctua

Tout ce qui a été posté par keymlinux

-

M8 et M20 - la Lagune et la Trifide - 11/07/2024

keymlinux a répondu à un sujet de Celebrinnar dans Astrophotographie

on l'attend avec impatience ! C'est disponible ici Cordialement -

M8 - M20 - Nébuleuses de la Lagune et Trifide - 14/07/2024

un sujet a posté keymlinux dans Astrophotographie

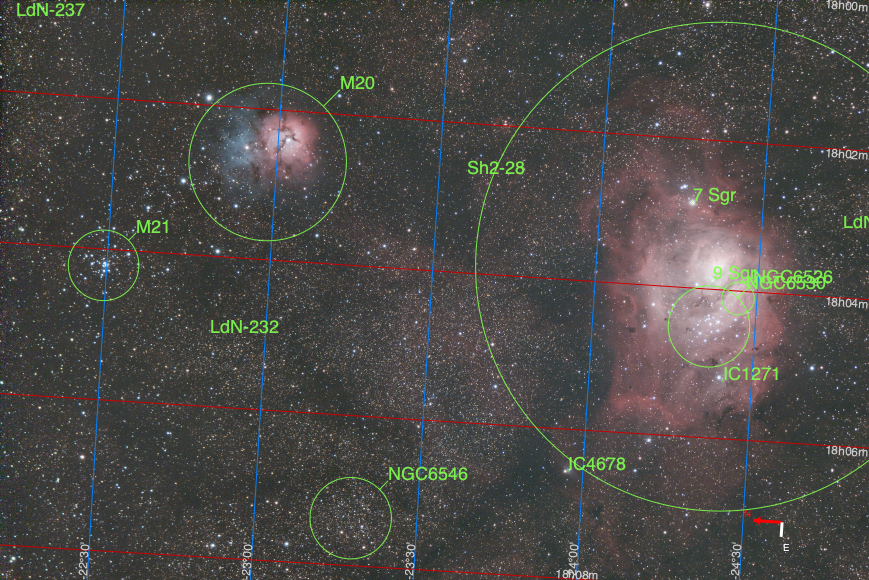

Bonjour, Malgré une météo peu clémente il est bon de se rappeler que c'est l'été , et le Sagitaire offre de belles cibles. Je vous propose les nébuleuses de la Lagune et Trifide. On vise la Voie Lactée, donc il y a du monde sur la photo. Ces cibles restent basses sur l'horizon, ce qui réduit leur période de visibilité dans des conditions acceptables Capture: - 63 poses de 60 secondes (j'avais prévu 90 poses mais des problèmes informatique ont écourté ma session) - Darks + offsets, mais manque les Flats (suite aux problème info, la prochaine fois je les ferais en début de séance...) - prises de vues à gain 125, offset 25, température -10°C Le setup: - monture SW AZ-EQ6 - lunette SW Equinox 80/500 - correcteur TSFLAT2 - camera PlayerOne Poseidon-C - guidage au diviseur optique avec ASI290mini (guidage en AD seulement) - filtre L-PRO - Kstars/Ekos/Indi sur un raspberry pour piloter le setup Traitements: - pre-traitement via Sirilic / Siril - traitement Siril -- Debruitage -- Deconvolution -- Photometrie -- Etirement Hyperbolique Généralisé -- Retrait du bruit vert -- Saturation - post traitement Gimp (MakeDarkSky via plugins PyGapM27) notes: - j'ai enfin réglé mon problème d'ombre du prisme du DO qui dépassait sur le capteur - première utilisation du correcteur TSFLAT2 (non réducteur), il faut que je l'éloigne un peu du capteur pour avoir une meilleure correction dans les coins - je n'ai pu activer le guidage qu'en AD seulement, en DEC impossible de passer l'étape de calibration (je n'ai pas pu déterminer si c'était un problème d'équilibrage ou bien lié au fait que la cible était presque au méridien en début de séance avec un axe de DEC quasi à l'horizontale...) - le cadrage aurait mérité un peu plus de centrage, mais je voulais aussi avoir M21 sur la photo Le résultat Astrometrie Cordialement, Stéphane -

Vitesse en traversée d'horizon d'un trou noir

un sujet a répondu à keymlinux dans Astronomie & Astrophysique

Bonjour, Je pense que c'est lié au fait que la vitesse de libération d'un astre et la vitesse terminale de chute vers cet astre sont les mêmes. Par exemple, autre exercice de pensée, si on considère un corps à l'infini qui chute vers la Terre et si on fait abstraction de toute autre élément (planètes, soleil, etc, mais aussi de l'atmosphère terrestre sur les derniers Km) alors sa vitesse de chute à l'arrivée sera au moins égale à la vitesse de libération (égale si l'object avait une vitesse initiale nulle) Par analogie, vu que la vitesse de libération d'un trou noir au niveau de son horizon est la vitesse de la lumière dans le vide, donc un objet qui tomberait depuis l'infini avec une vitesse initiale nulle atteindrait l'horizon avec une vitesse égale à celle de la lumière. Mais cette vitesse étant une limite non atteignable pour un corps massif (impliquant pour un corps massif une énergie infinie non atteignable), la question est alors de savoir si l'analogie ne trouve pas ici aussi ses limites. -

Problème connection 2600Mc

keymlinux a répondu à un sujet de yvesruth dans Matériel astrophotographique

Bonjour, Pour le gain sur sur ASI2600MC je te conseille de le mettre à 100 Pour aider à déterminer le temps de pose approprié a tes conditions de prise de vue, je te conseille la lecture du sujet ci dessous Cordialement, Stéphane -

M8 et M20 - la Lagune et la Trifide - 11/07/2024

keymlinux a répondu à un sujet de Celebrinnar dans Astrophotographie

Bonjour, Bravo, belle prise, et effectivement entre une météo capricieuse, des nuits courtes et une position basse sur l'horizon ce ne sont pas des cibles faciles. J'ai fait la même cible la soirée du 14 juillet, je viendrais vous présenter le résultat d'ici peu. Cordialement, Stéphane -

SIRILIC 1.15.12 pour SIRIL 1.2.3 ** Mise à jour **

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

Bonjour Pascal, J'ai testé la version 1.15.9rc1, c'est OK pour moi, sélection de la valeur par défaut pour le chemin du binaire Siril, lancement OK de Siril et siril-cli. Merci. Cordialement, Stéphane -

[Résolu] Qu'est-ce qui cloche là-dedans ?

keymlinux a répondu à un sujet de FalCT60 dans Aide SIRIL de Siril et Sirilic

Si tu baisse le gain cela augmente le bruit de lecture (par contre tu gagne en full well et en dynamique) -

SIRILIC 1.15.12 pour SIRIL 1.2.3 ** Mise à jour **

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

Bonjour @m27trognondepomme Depuis la sortie des versions Siril 1.2.1 et supérieures il y a un nouveau problème sur MacOS (pas testé avec les autres OS) Jusqu'en version 1.2.0 les binaires "siril" et "siril-cli" étaient dans le même répertoire. Coté Sirilic on paramètre l'emplacement du binaire Siril (avec la valeur par défaut "/Applications/SiriL.app/Contents/MacOS/siril") et pour le lancement de "siril-cli" cela fonctionne car a priori Sirilic tente de le lancer depuis le même répertoire que "siril" A partir de la version de Siril 1.2.1 les binaires siril et siril-cli ne sont plus dans le même répertoire (sur MacOs en tout cas) On a : /Applications/SiriL.app/Contents/MacOS/siril et /Applications/Siril.app/Contents/Resources/bin/siril-cli Je te laisse voir comment gérer ce nouveau cas particulier.... Personnellement pour pallier (temporairement) au problème, je configure dans le chemin de Siril celui de siril-cli, cela permet aux scripts de fonctionner, seul le lancement du gui siril ne fonctionne plus, mais je le lance hors sirilic en fin de script... Cordialement, Stéphane -

[Résolu] Qu'est-ce qui cloche là-dedans ?

keymlinux a répondu à un sujet de FalCT60 dans Aide SIRIL de Siril et Sirilic

Bonjour, Le premier masterdark que tu fournissait avait une valeur moyenne très basse (environ 40) vu que tu lui enlevait le bias Le nouveau (classique) sans soustraction du bias a une valeur moyenne vers 1040 (ce qui me laisse penser que le bias est de 1024, ce qui est en phase avec ton offset camera de 16) Mais la brute que tu fourni montre que le signal moyen est très proche de la valeur du dark, donc lors de la soustraction du dark des valeur negatives apparaissent. Il me semble que la remarque de Cécile sur le fait que tes brutes manquent de signal reste d'actualité Cordialement -

Conseil pour un setup astrophoto transportable

keymlinux a répondu à un sujet de Seb45 dans Matériel astrophotographique

Dans la plupart des cas on fixe sur l'APN un adaptateur Canon-EF vers pas de vis M42 ou M48, puis on fixe sur ce pas de vis un coulant 2pouces que l'on insère dans le porte oculaire et il est tenu dans le porte oculaire via une ou plusieurs vis. Ce type de montage peut être source de "tilt", le coulant pouvant être un peu en bias dans le porte oculaire (c'est un problème que je rencontre avec mon porte oculaire, qui en plus ne dispose que d'une seule vis pour bloquer). Certains préfèrent (lorsque cela est possible) un train optique tout vissé. J'entend par la que si le porte oculaire dispose en sortie d'un pas de vis (M54 ou plus grand), on peut alors visser les adaptateurs, cela garanti plus de rigidité et un meilleur alignement, cela réduit donc le risque de "tilt". Mais dans ce cas on ne peut pas visser un filtre intermédiaire (le filtre ne dispose habituellement pas d'un filetage des 2 cotés, et même si c'est le cas il n'est pas fait pour supporter des contraintes liées au poids), dans ce cas un utilise un tiroir a filtre qui dispose de tels filetages des 2 cotés ce qui permet une fixation solide, et on insère le filtre dans le porte filtre edit: oui l'interêt du filtre eEOS-clip c'est que l'on peut l'utiliser avec un objectif, mais seulement avec des objectifs EF, pas avec les EF-S car ils ont une partie qui rentre à l'intérieur du corps de l'APN et qui risquerait de toucher le filtre. Mais le 70-20 f4 est normalement un EF, donc pas de problème (EF: objectif compatible avec les Canon APS-C et 24x36, EF-S: objectif compatible avec les Canon APS-C seulement) Cordialement -

Conseil pour un setup astrophoto transportable

keymlinux a répondu à un sujet de Seb45 dans Matériel astrophotographique

Bonjour - Avec un APN + son objectif photo, pas de problème de back focus a respecter - Avec une lunette, si tu n'ajoute pas d'aplanisseur/réducteur là non plus pas de problème de backfocus (pareil si c'est un aplanisseur intégré type montage de petzval, pas de backfocus à respecter) - Par contre si tu prend une lunette et que tu ajoute un aplanisseur/réducteur, alors là tu aura un backfocus (habituellement de 55mm) à respecter et sur un APN Canon on a déjà 44mm de consommé entre l'entrée de l'APN et le capteur, reste 11mm, donc pas de tiroir à filtre. Avec une camera qui consomme 12,5 ou 17,5mm seulement (et pas 44mm comme un Canon) , cela laisse de la place pour un tiroir à filtre et pour un diviseur optique. Avec un APN tu peux aussi utiliser un diviseur optique, mais comme il ne reste que 11mm il faut en prendre un très fin comme celui de Orion (que j'utilisais avec mon apn avant de passer sur une caméra) Pour placer le filtre tu auras 2possibilités: - utiliser un filtre EOS-Clip à placer à l'intérieur de l'apn, juste devant le capteur (mais tu ne le réutilisera pas si tu passes plus tard à une camera) - utiliser un filtre 2" vissant M48 que tu placeras sur le tube du coulant 2" à insérer dans le porte oculaire (cela implique de ne pas avoir un train optique "tout vissé") C'est un risque, mais l'idée est d'utiliser une camera de guidage très sensible et monochrome (exemple asi290mm), et ce n'est pas trop un problème avec une focale pas trop longue (le champ couvert reste important et permet de trouver plus facilement une étoile guide) Cordialement, Stéphane -

Le bouton "suivre" permet d'activer le suivi d'un sujet et d'être alerté, mais reste a choisir le type d'alerte entre la cloche de notification sur le site ou par mail --> et cela cela se paramètre dans "paramètres du compte" / "paramètres des notifications" Pour être prévenu sur le contenu suivi c'est dans "general", par contre être prévenu si tu es cité ou obtiens une réponse sur un sujet que tu as initié c'est dans "Mentions & my content"

-

Echec de l'ouverture de fichier fits

keymlinux a répondu à un sujet de XavierD dans Aide SIRIL de Siril et Sirilic

Bonjour, J'ai testé la version 1.2.2 sous MacOS, pas de soucis à l'ouverture de fichiers fit ou fit.fz (compressés) Je suppose que tu utilise Siril sous Windows, à tout hasard, tu devrais tester avec un fichier fit dont le nom (de fichier et de répertoire) ne contient ni espace ni caractère accentués Cordialement, Stéphane -

Comment trouver l'emplacement d'une étoile dans le ciel sans logiciel tiers ?

keymlinux a répondu à un sujet de Mortann dans Astronomie & Astrophysique

@Mortann Pour info il existe une librairie python très complete pour les calculs astro "astropy" qui permet entre autres de passer d'un système de coordonnées à un autre (même si c'est très bien de coder sois même pour comprendr le détail du calcul) Astropy: https://docs.astropy.org/en/stable/install.html EDIT: Un livre "Python for Astronomers" en accès libre ici: https://prappleizer.github.io Cordialement -

Comment trouver l'emplacement d'une étoile dans le ciel sans logiciel tiers ?

keymlinux a répondu à un sujet de Mortann dans Astronomie & Astrophysique

Bonjour, Si tu prend un catalogue donnant la position des astres (coordonnées équatoriales), tu obtiendra une ascension droite (AD) et une déclinaison (DEC) Ces coordonnées sont fixes (*) donc ne dépendent pas de l'heure ni de la position de l'observateur (elles varient un peu dans le temps et sont recalculées tous les 50 ans, actuellement on utilise le calcul de l'époque J2000) Pour tenir compte de la position de l'observateur et de son heure locale, on va calculer l'heure sidérale locale (LST), et on pourra calculer l'angle horaire (AH) de l'astre avec AH=LST - AD (la coordonnée DEC ne change pas), mais on reste dans une cordonnée équatoriale Ensuite on converti la coordonnée équatoriale en coordonnée azimutale C'est ce que fait stellarium, c'est ce que fait le calculateur ici http://xjubier.free.fr/site_pages/astronomy/coordinatesConverter.html Maintenant si tu veux le détail des calculs, je t'invite a te procurer le livre "Calculs astronomiques a l'usage des amateurs" en vente pour 13euros sur le site de la SAF https://boutique.saf-astronomie.fr/produit/calculs-astronomiques/, les notions et calculs sont bien détaillés et expliqués. Tu peux aussi jeter un oeil ici https://abbadia.imcce.fr/doc-cours/cours-sph_celeste_astrometrie-JEA-2014.pdf Il y a les formules, mais aussi des schémas, c'est un support de cours donc fait pour expliquer... note: IMCCE = Institut de mécanique céleste et de calcul des éphémérides Cordialement, Stéphane -

Bonjour, Comme l'ont précisé les intervenants précédents, il y a 2 problèmes principaux: la mise au point et le ciblage (pour pouvoir faire la mis eau point il faut qu'il y ait une cible dans le champs ou au moins quelques étoiles bien visibles) La combinaison d'un télescope a longue focale comme le mak127 et d'un petit capteur, ce n'est pas le plus facile pour commencer (mais c'est bien si tu veux faire du planétaire, c'est juste que c'est plus compliqué pour débuter). Avec une telle config il te sera difficile d'être sûr d'avoir la cible dans le champs, et donc difficile de faire la mise au point (MAP) Pour ce qui es de la MAP, normalement sur les MAK le foyer sort pal mal du télescope, donc on peut l'atteindre avec une camera (contrairement à certains newton fait pour le visuel où atteindre le foyer avec un APN ou une camera peut être impossible) Vouloir faire la MAP de nuit sans savoir si on est proche du point au pas, sans savoir si il faut ajouter un tube allonge ou pas pour l'atteindre, et sans être sûr d'avoir une étoile bien visible dans le champ couvert, c'est un peu suicidaire (si on est très défocalisé, les étoiles étant tellement "étalées" on ne voit que du noir, pas les étoiles distinctes). Comme l'a signalé @Tiyann, il est plus facile de commencer par faire la mise au point en utilisant son telescope de jour en visant un clocher ou un arbre situé loin. Eventuellement la nuit en visant la lune. Et pour finir, pour faire suite à ton dernier message, on ne fait pas la mise au point sur une camera astro. Une camera astro c'est juste un capteur, il n'y a pas d'optique (contrairement à un smartphone), les réglages sont la durée de prise de vue, et le gain (sensibilité/amplification du signal) (y'a aussi l'offset mais pour le moment on va l'ignorer). La mise au point se fait avec la molette de mise au point du télescope, il n'y a pas de mise au point sur la camera. La camera se place en remplacement de l'oculaire (contraient à un smartphone que l'on met derrière l'oculaire) . La mise au point pour l'oculaire et pour la camera seront différents. Cordialement

-

Bonjour, On ne peut pas dire que l'on croule sous les informations, cela va être difficile d'aider... Quelle camera ? marque et modele ? Tu l'utilise avec quel télescope ? Tu utilise quel logiciel pour la camera ? logiciel fourni par le constructeur . ou générique type Sharpcap/Firecapture/etc ? Tu a déjà fait de l'imagerie avec une autre camera ou APN ? edit: et si tu as une photo de ta camera montée sur ton telescope cela sera un plus pour donner un avis Cordialement

-

Eclipse du 8 avril 2024, depuis l'Arkansas

keymlinux a répondu à un sujet de keymlinux dans Astrophotographie

Bonjour. Ben çà dépend.... Pour le 8 avril dernier la totalité max était de 4min20, donc plutôt long, et à Conway je n'étais pas sur la ligne centrale, je n'avais pas 4min20 mais 3min50, et mon opinion c'est que c'était suffisant. Certains dirons que ce n'est jamais assez, mais le rapport plaisir/galère était bon. A savoir que pour avoir 30 secondes de plus et donc pour aller sur la ligne de centralité cela voulait dire se taper des embouteillages et se poser à l'arrache en bord de route surpeuplé. Là j'étais peinard sur le parking de l'hôtel, pas bousculé, il n'y avait pas grand monde, mais du coup il y avait moins d'ambiance aussi. Il me semble que pour aout 2026 on sera plutôt sur une durée de 1min30, donc là oui c'est court, donc autant être au plus près de la ligne de centralisé pour ne pas trop perdre Pour le 8 avril dernier en Arkansas on avait entre 4min20 et 2min20 selon que l'on était sur la ligne de centralité ou en limite de zone de totalité. Pour aout 2026 en Espagne on sera entre 1min40 sur la ligne de centralité et 40sec en bordure. A toi de voir ce qui te semble être "acceptable" comme durée. Sur la carte de Xavier Jubier, lien ci contre, tu verra la durée de la totalité en fonctio de l'endroit où tu compte te poser (clique sur la carte pour choisir une position) http://xjubier.free.fr/site_pages/solar_eclipses/TSE_2026_GoogleMapFull.html Cordialement, Stéphane -

Paramétrage ekos et caméra player one

keymlinux a répondu à un sujet de bibblx dans Astrophotographie

@bibblxBonjour. Avec quelle version Indi as tu fais les tests ? Il y a eu une mise a jour de Indi 2.0.7 à 2.0.8 le 1er juin, et cela a corrigé certains problèmes que je rencontrais avec une P.O Poseidon-C. Si tu n'as pas fais de mise à jour depuis le 1er juin je invite à la faire. Si tu es déjà désolé je n'ai pas d'autre idées pour aider... -

Idée et question boite à Flats.

keymlinux a répondu à un sujet de -JFK- dans Matériel astrophotographique

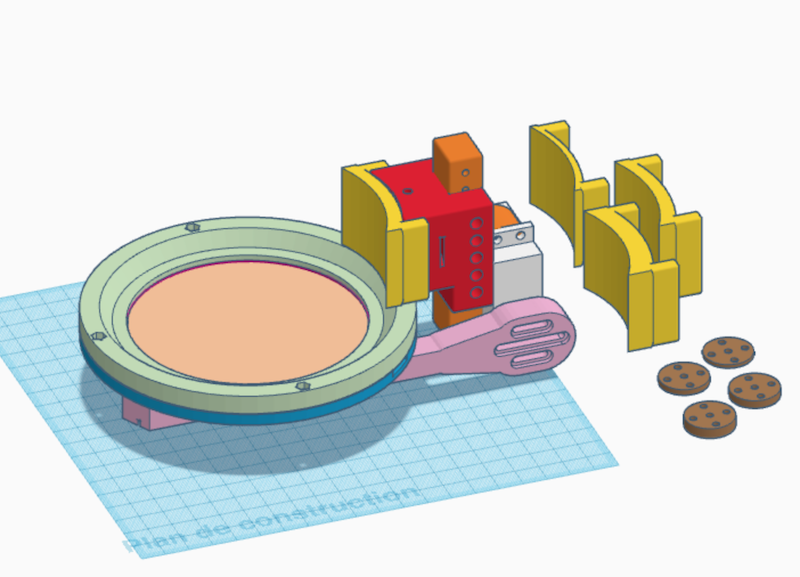

@jduffasBonjour, j'ai eu le même problème pour réaliser une boite a flat pour un Newton 10pouces, trop grand pour imprimer la pièce en une fois. Finalement j'ai gardé l'idée du panneau electroluminescent, mais en modélisant un support en 4 parties plus petites. Les parties sont assemblées avec des vis Voir le sujet ici, qui décrit la boite et donne les liens pour le déchargement des STLs Et accessoirement je bosse en ce moment sur un flip flat pour une petite lunette de 80mm --> boite a flat fixée sur un bras mobile, motorisé avec un servo-moteur, et pilotable via Kstars/Ekos/indi que j'utilise pour la prise de vue. Une fois terminée je ferais un post dédié sur le forum, en attendant, ci dessous une vue du modèle 3D et de la version imprimée Cordialement, Stéphane -

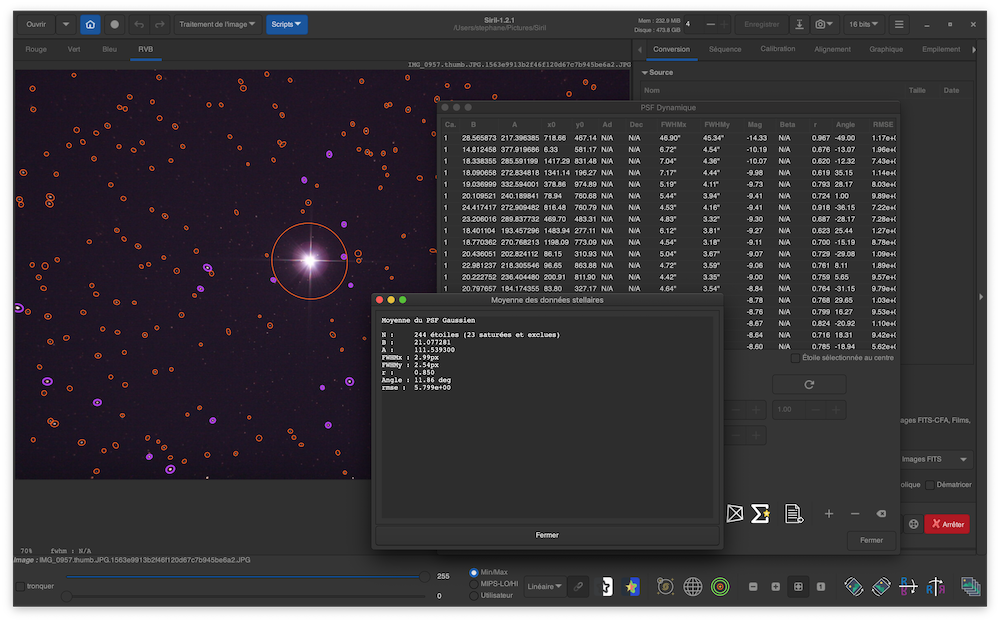

Bonjour, Pour la mise au point, même avis, je trouve cela très bien si l'on considère qu'il n'y a aucune "assistance" Pour affiner tu peux aussi prendre une photo, puis l'ouvrir dans Siril pour faire des statistiques sur la taille (en pixel ou arc-second) des étoiles, ce qui te permettra par itération successives d'affiner la mise au point (via menu hamburger / informations de l'image / PSF dynamique) Pa exemple, en ouvrant ton image jpeg (vu qu'elle est réduite à 1500x1000 pixels les calculs fait par siril sont erronés, mais c'est juste pour montrer le procédé) Il calcule la FWHM des étoiles (en gros leur taille, plus cette valeur est faible mieux c'est) et le ratio hauteur sur largeur (plus c'est proche de 1 plus c'est rond, plus c'est proche de 0 plus des étoiles sont allongées et déformées) En moyenne sur ton image le ratio est de 0.85, et si on calcule sur une zone qui élimine les bors de l'image on est sur 0.9. Donc deformation légère, plus due à la coma qu'a un défaut de suivi (avec un défaut de suivi même les étoiles au centre sont ovales) Sur Vega on voit bien les aigrettes, et on voit bien qu'elle sont dédoublées, ce qui arrive lorsque l'araignée (le support du miroir secondaire) est déformé (les branches de part et d'autre du secondaire ne forment pas une ligne droite) Cordialement, Stéphane

-

C11 vis de collimation du secondaire enlevé - impossible de les remettres

keymlinux a répondu à un sujet de cbrunfranc dans Matériel général

Bonjour, Oui, il y a un alignement à respecter entre les miroirs primaires et secondaire, ainsi qu'avec la lame de fermeture, que tu as du démonter du tube pour accéder au secondaire. Normalement sur la tranche de la lame de fermeture et sur le coté du support du miroir secondaire il y a des repères (dès fois ils ne sont pas très visibles, raison pour laquelle il est conseillé de faire ses propres marques lors du démontage ) Tous les détails sur le site suivant: http://www.bbayle.com/page_modif_c8/ Cela m'a bien aidé lors du démontage/remontage de mon C8 (mais j'avais lu les conseils avant de démonter 🙂 ) Pour le C11 les conseils généraux sur les précautions restent les mêmes que pour un C8 Cordialement -

Journées Camille Flammarion, Juvisy sur Orge

un évènement du calendrier a posté keymlinux dans Communauté

jusqu’àBonjour, Les samedi 1er et dimanche 2 juin, la Société Astronomique de France organise les Journées Camille Flammarion, à Juvisy sur Orge A cet occasion l'observatoire sera ouvert à la visite à partir de 14h (visite possible le matin sur réservation auprès du secrétariat de la SAF) Selon les conditions meteo des observations solaires seront proposées Toute les infos sur le site de la SAF, ici: https://saf-astronomie.fr/journees-camille-flammarion/ -

Tri avant traitement - suite

keymlinux a répondu à un sujet de FalCT60 dans Aide SIRIL de Siril et Sirilic

Bonjour, Vu que tu es sous Linux et que tu ne souhaites pas utiliser Wine (pourquoi ?), donc exit les programmes sous windows style autostakkert, avistack, pipp et registax (que j'utilise avec success avec Wine sur MacOS) ... exit aussi les programmes natif MacOS comme Lynkeos, il ne reste plus beaucoup de choix... Je t'invite a tester PlanetarySystemStacker qui est un programme python, et normalement il y a python en standard sur toutes les distributions Linux (il y aura quelques librairies Python a installer en pré-requis. Voir les détails ici https://github.com/Rolf-Hempel/PlanetarySystemStacker note: quand tu dit que tu as 14000 photos, j'espère que c'est une vidéo de 14000 images et pas 14000 fichiers photos séparés... Avec un fichier video (si possible au format SER) c'est plus pratique à traiter. Cordialement, Stéphane -

C'est prévisible, mais comme pour la meteo les prévisions peuvent s'avérer imprécises.... Je ne suis pas un spécialiste, mais voici quelques éléments Le soleil est observé en permanence donc les éruptions qui éjectent de la matière (protons + electrons) sont vues. 8 minutes après on est au courant de l'eruption (temps de propagation moyen de la lumière entre le soleil et la terre) Cette matière éjectée met 2 à 3 jours nous parvenir (elle se déplace bienn moins vite que la lumière), donc on a des previsions à 3 jours Quelques heures avant d'atteindre la terre le flux de matière atteint des satellites positionnés au point de Lagrange entre elle soleil et la terre, ce qui va permettre de mesurer les caractéristiques magnétique du flux et donc de savoir ci cela sera propice à la formation d'aurores et avec quelle intensité (donc à priori les infos précises c'est de la prévision à 3 heures seulement et pas 3 jours) Il y a des sites spécialisés comme ici: https://www.spaceweatherlive.com/fr/activite-aurorale/previsions-aurorales.html https://www.spaceweather.com @fredogotobravo pour la photo Cordialement, Stéphane