-

Compteur de contenus

9150 -

Inscription

-

Dernière visite

-

Jours gagnés

80

Type de contenu

Profils

Forums

Téléchargements

Blogs

Boutique

Calendrier

Noctua

Tout ce qui a été posté par Colmic

-

Petit test mode 8bits et 16bits avec une asi184mm sur le soleil.

Colmic a répondu à un sujet de Nature Photo dans Astrophotographie

Ben tu reviens quand t'as les sources En attendant tu précises toujours pas CP ou planétaire ou lunaire ou solaire. En solaire, les cadors sont d'accord pour dire qu'on peut se contenter du 8 bits, mais tout dépend de la caméra, du contexte etc.. Et il faut surtout avoir bien compris la différence entre 8 et 16 bits au niveau de l'enregistrement de l'image. Quand on a un objet lumineux comme le Soleil, on peut se contenter de 8 bits car la dynamique va être très grande, en revanche quand on recherche des petites pétouilles ou des détails faibles, là il faut monter à 16 bits (si tant est que le PC et le disque suivent derrière). Oui je la connais bien j'en ai une en CP de 183, c'est la même que la tienne mais avec refroidissement en plus. Au niveau de zoom où tu postes tes images, on peut absolument rien déduire du tout, il faut zoomer dans les full pour bien se rendre compte. De plus en solaire, les mouvements de convection de la granulation sont très rapides, donc si tu fais des films de plus de 30s c'est mort, c'est bougé. Mais tu ne le verras pas sur une image du Soleil en entier, la résolution est bien trop faible pour pouvoir juger. Donc sur un Soleil en entier au final on s'en fout du 8 ou du 16 bits La 183 est une caméra 12 bits, donc tu as le choix au final de rester en 8 bits AVI, ou de monter en 16 bits SER, mais tu verras la différence uniquement sur des gros plans. PS : j'ai fait un petit article sur les CMOS, dispo dans ma signature, toujours bon à lire. -

Petit test mode 8bits et 16bits avec une asi184mm sur le soleil.

Colmic a répondu à un sujet de Nature Photo dans Astrophotographie

En planétaire ou en CP ? Source ? 33ms de temps de pose, ça veut dire que tu ne peux pas dépasser 30 images par seconde, sinon tu perdras des images. -

Petit test mode 8bits et 16bits avec une asi184mm sur le soleil.

Colmic a répondu à un sujet de Nature Photo dans Astrophotographie

Qui est ce ON ? EDIT : Il faut bien comprendre à quoi ça sert de stacker plus d'images. C'est surtout une histoire de rapport signal/bruit. Si tu stackes plus d'images, ton bruit baisse, donc tu peux appliquer des ondelettes plus fortes sans dénaturer l'image. C'est pas une règle absolue, ça dépend du seeing, du F/D, beaucoup de la caméra etc.. Aujourd'hui on raisonne en terme de rapidité ou de FPS pour une caméra. Ce n'est pas un bon choix. Le bon choix c'est de trouver une caméra qui peut descendre suffisamment en temps de pose donc une caméra très sensible. Imaginons une caméra A qui peut faire du 100 FPS mais dont la sensibilité n'autorise que des poses de 20ms sur le Soleil. La caméra B quant à elle ne fait que du 30FPS mais est suffisamment sensible pour permettre un temps de pose de 5ms. 100 images par seconde veut dire que la caméra A ne doit pas excéder un temps de pose de 10ms, si on doit lui coller 20ms alors elle ne pourra enregistrer que 50 images par seconde. En revanche la caméra B qui ne fait que 30 images par seconde aura enregistré toutes ses images à 5ms et pourra passer plus facilement dans les trous de turbu à 5ms que la caméra B à 20ms. Donc plus important que le FPS c'est la sensibilité de la caméra qui compte, couplé à une bonne dynamique de base pour éviter de trop empiler et un bruit de lecture très faible. EDIT2 : un bon exemple est sur mon tuto sur la mosaïque solaire en signature. Ma caméra Point Grey est paramétrée sous Firecapture en SER 16 bits et le temps de pose est de 8ms avec gain toujours à 0. Dans Autostakkert, je demande à stacker 64 images, pas plus, ce qui me donne une image empilée de 15 bits (pour rappel caméra 12 bits). Et le résultat est tout en bas... -

Petit test mode 8bits et 16bits avec une asi184mm sur le soleil.

Colmic a répondu à un sujet de Nature Photo dans Astrophotographie

Salut, la règle est très simple : empiler 4 images revient à gagner 1 bit de dynamique. Pour 16 images 2 bits, 64 images 3 bits, 256 images 4 bits, 1024 images 5 bits etc... Si tu empiles 500 images sous Autostakkert en 8 bits, tu as obtenu une image résultante de 12.5 bits. Si tu empiles 500 images sous Autostakkert en 16 bits, tu as obtenu une image résultante de 20.5 bits, ce qu'autostakkert ne sait pas traiter (16 bits maxi). Voilà... EDIT : précisions... A l'époque (lointaine) où je faisais exclusivement du solaire, j'utilisais une caméra CCD Point Grey avec capteur ICX674 (le petit frère du 694 qui équipe les Atik One). Cette caméra était 12 bits. Par conséquent je faisais mes images en SER 16 bits (mais 12 en réalité) et je n'empilais jamais plus de 256 images pour ne pas dépasser 16 bits, plus souvent autour de 64 images. -

Salut, belle image mais il me semble qu'elle est inversée miroir

-

Néb diff La trompe d'éléphant c'est compliqué !

Colmic a répondu à un sujet de Guy53 dans Astrophotographie

Salut, l'ASI183 a son gain unitaire à 110 (je ne sais pas si chez QHY c'est pareil ?), et plus vous montez le gain plus vous réduisez le bruit de lecture. A gain 10 ou 15, certes vous avez vos puits de potentiel à leur plus haute valeur et donc moins de risque de cramer les étoiles, mais non seulement vous perdez sur le bruit, mais en plus je suis même pas sûr qu'à 300s vous atteignez les 3 sigmas. En narrowband il faut monter le gain, il n'y a déjà pas beaucoup de signal. Sinon vous restez à gain 50 mais alors là faut poser au moins 10 minutes. Ceci dit, belles images Guy -

Et de même pour moi. Au plaisir de te rencontrer et d'en rire autour d'un verre

-

Alors désolé si je n'ai pas compris, tu es toi aussi difficile à suivre Déjà je n'ai pas écrit vengeance, mais revanche relis bien. Disons que si tu n'avais pas mentionné le "Que diable" dans ta première intervention je n'aurais même pas répondu. Mais désolé, je ne te comprends pas comme celui qui souhaite juste ajouter ou reprendre gentiment, mais le "que diable" est là plutôt pour rabaisser ou engueuler. C'est exactement la même remarque que le "c’est juste que ce qui est écrit n’est pas exact. Point." dans l'autre topic, avec le mot "POINT" à la fin qui signifie fin de discussion. Tu continues en précisant "M'abstenir est l'attitude la plus intelligente...", là aussi c'est très maladroit, en gros je le comprends comme "c'est le plus intelligent qui cède" D'ailleurs à ce sujet j'attends toujours que tu me démontres que "ce qui est écrit n'est pas exact" dans l'autre topic, et stp on va pas jouer entre nous sur de la sémantique puissance/énergie quand même ? On peut aider effectivement, mais il y a la manière de le faire... Je te serre également la paluche.

-

Conseils matériel pour transformer une lunette EVOSTAR 72ED

Colmic a répondu à un sujet de -Amenophis- dans Astrophotographie

ben un bouchon oui mais pas en plastique -

ben là aussi t'as de la lecture dans ma signature

-

Oui c'est pas assez cher mon fils. Gaffe au vice caché.

-

Conseils matériel pour transformer une lunette EVOSTAR 72ED

Colmic a répondu à un sujet de -Amenophis- dans Astrophotographie

Je dois dire que ça fait des annés que je n'image plus en solaire, je me rince juste les yeux en bino avec mon Intes 180 + PST C'est pas un renvoi coudé, c'est le BF et les BF sont tous en renvoi coudé sauf le BF30 de chez Coronado. Attention, si tu laisses la caméra au cul de la lunette, il faut savoir que les bouchons plastique laissent passer les infrarouges, et que le capteur risque de prendre cher. -

(Topic unique) Tout sur ASiair / ASiair Pro / ASiair Plus

Colmic a répondu à un sujet de Colmic dans Astrophotographie

Essaie déjà de régler le backlash de ton EAF. Oui je sais l'ASiair n'en tient pas compte, en attendant ça aide beaucoup à pas être emmerdé. -

Excuse moi @gastair mais il fut un temps pas si ancien, on refaisait nous-mêmes les niveaux avec de l'électrolyte en bidon (bidon que je dois toujours avoir dans ma cave d'ailleurs). Alors je te l'accorde, c'est pas tout le monde qui faisait ça Et je te l'accorde aussi, j'ignorais qu'on avait interdit les bidons d'électrolyte depuis Maintenant moi je suis là uniquement pour aider les gens qui posent des questions, j'ai passé 3 posts à essayer d'aider Pyrou, j'ai même pris le temps de chercher la référence de sa batterie pour l'aider encore mieux. Toi t'arrive là après la bataille sans même lire l'intégralité du topic, juste pour dire "jamais d'eau dans le gel que diable!", le cas est similaire au post sur les batteries LiFePo4 (post où on ne t'a plus revu ensuite d'ailleurs ) Donc non je le prends pas mal, mais j'ai l'impression très forte que toi tu avais un besoin de revanche (d'où le "un partout" c'est ça ?) et que c'est toi plutôt qui l'avait mal pris. Avec les connaissances que tu as, tu pourrais toi aussi essayer d'aider ceux qui posent des questions, pas juste venir reprendre ceux qui le font. Sans rancune

-

+1 on n'est jamais trop prudent avec le Soleil. Même avec un trou de 5cm d'ailleurs ça peut suffire à perdre un oeil. D'ailleurs si on lit bien la notice de l'Astrosolaar, on a des exemples de montage avec au minimum 2 cartons imbriqués et la feuille entre les 2. EDIT : si on en revient au Solarlite, j'ai eu l'occasion d'observer dedans, c'est pas aussi bon que de l'Astrosolaar quand même. C'est du polymère, alors oui ça se déchire moins facilement que l'Astrosolaar mais c'est moins bon optiquement parlant.

-

(Topic unique) Tout sur ASiair / ASiair Pro / ASiair Plus

Colmic a répondu à un sujet de Colmic dans Astrophotographie

Salut Philippe, pas d'accord avec ça, on a bien toujours des MAJ à faire même avec l'EAF v2. Hervé un copain a un v2 qui n'avait pas assez de couple pour monter la crémaillère de sa TOA150 au zenith (faut dire qu'avec la caméra et le gros D.O 3 pouces Skyméca, ça faisait 2 bons kilos à monter). On lui a fait sa MAJ et depuis l'EAF monte bien. Et ce point est bien mentionné dans le changelog de la v3.1.7 Et je parle bien d'un EAF v2 sans 12V. V3.1.5 修正 0度以下温度读取错误,导致程序出错 Corrected the temperature reading error below 0 degrees, causing program error. V3.1.6 修正 EAF设置运行长度为1步时,不工作问题 修正 电机过载保护机制 Fixed the problem that EAF does not work when the running length is set to 1 step Corrected motor overload protection mechanism V3.1.7 提高电机负载能力。 Increase motor load capacity. V3.1.9 修正 外置温度传感器精度 修正 内部数据保护功能 Corrected external temperature sensor accuracy Fixed internal data protection function V3.2.2 代码优化 支持EAF 5V Code optimization EAF 5V supported V3.2.3 代码优化 Code optimization https://astronomy-imaging-camera.com/software-drivers Onglet Firmware update. EDIT : je vois où tu fais l'erreur : Sur le site ZWO il est dit : These products are USB HID devices so do not need native drive. Ca c'est le driver, et oui l'EAF 5V n'a pas besoin de driver externe. En revanche le firmware interne c'est autre chose. -

Salut, pour te faire comprendre où tu fais erreur, imagine que tu as découpé 5 trous de 5cm dans ton bouchon, tu auras donc l'équivalent de 25 cm ? Avec 10 trous tu auras 50cm ? Ben non, t'auras toujours que 5cm, c'est juste que tes 2 trous vont fonctionner comme le principe de l'interférométrie. Le mieux c'est d'acheter une feuille d'Astrosolaar du diamètre de ton tube...

-

Conseils matériel pour transformer une lunette EVOSTAR 72ED

Colmic a répondu à un sujet de -Amenophis- dans Astrophotographie

Salut, pour l'ERF 2 adresses : - Teleskop Service qui réalise sur mesure des barillets en option si tu prends l'ERF directement chez eux - Skyméca boîte française où il suffit de donner le plan avec les cotes à Didier qui fait du très bon boulot pour pas trop cher Maintenant pour un Quark il n'y a pas besoin d'ERF jusqu'à 120mm de diamètre. Pour les couleurs du soleil à partir d'une image N&B => voir mon tuto Mosaïque solaire dans ma signature. Enfin, avec une 178 t'auras pas non plus le Soleil en entier. Mais avec un Quark il vaut mieux faire des mosaïques si tu veux avoir le champ pleinement Halpha. -

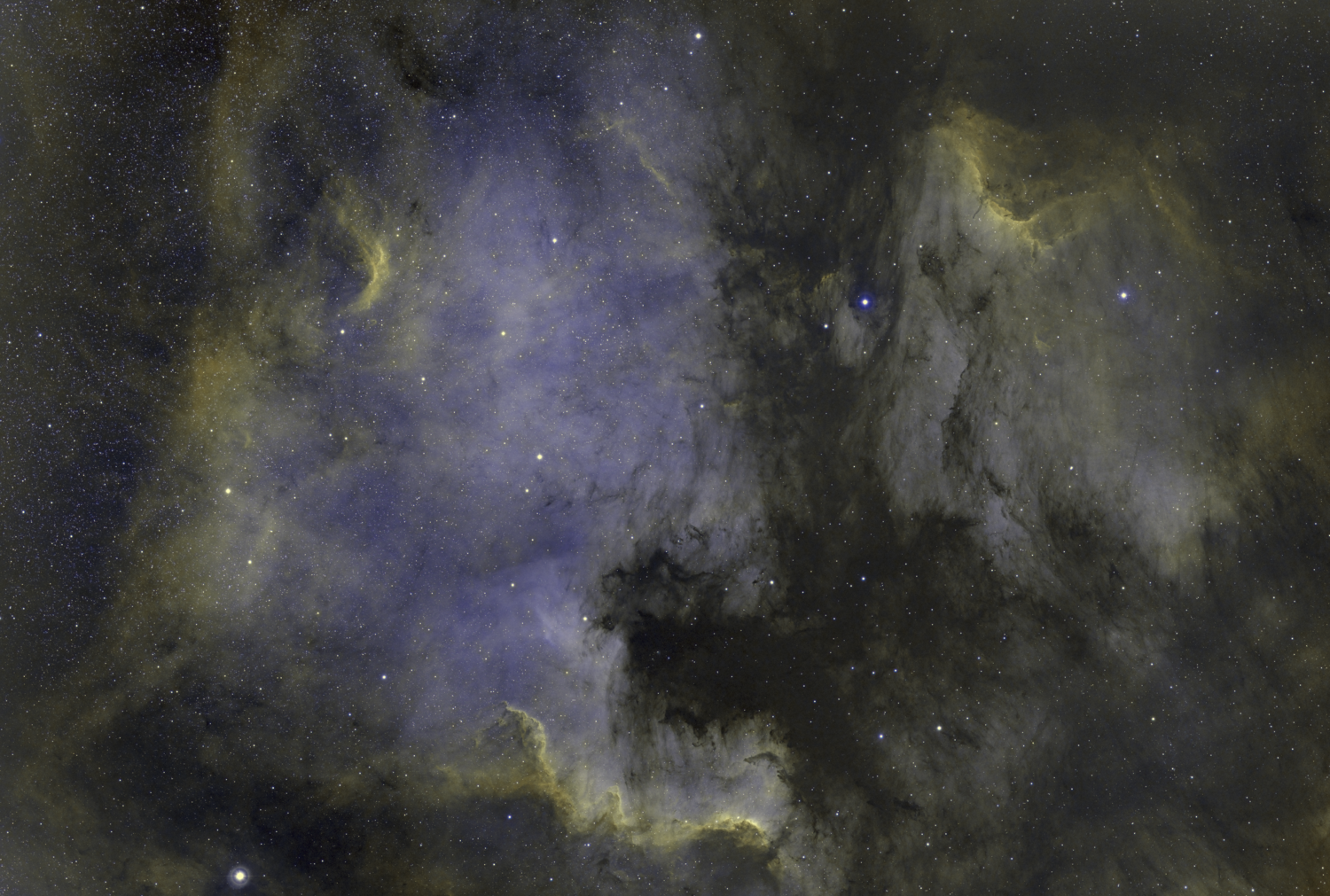

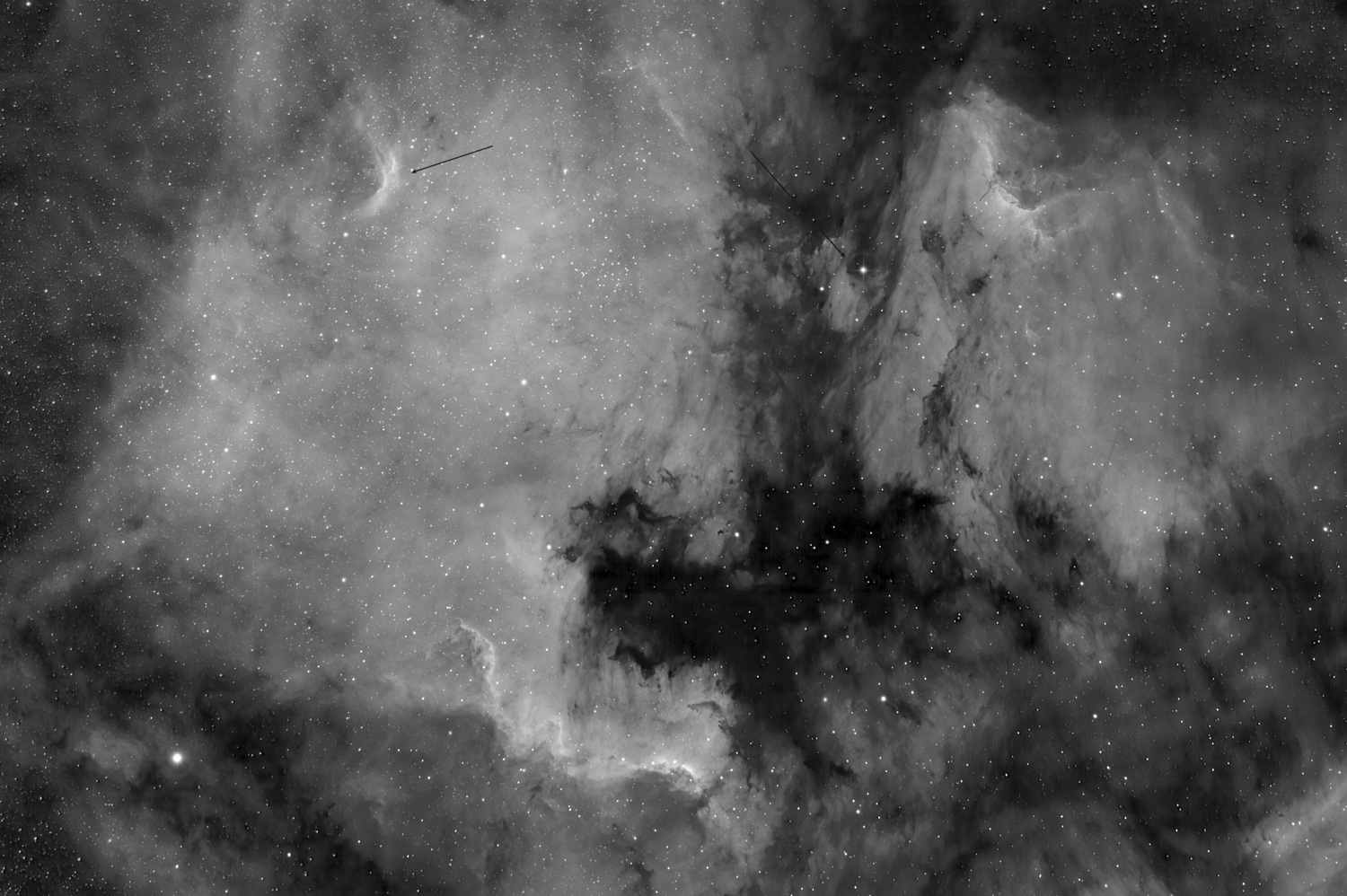

Lune, ville, temps de pose trop court, etc... Et surtout tu n'as pas pointé les zones intéressantes de la nébuleuse, soit le golfe du Mexique ou alors le Pélican qui sont riches en Ha. On la voit la nébuleuse, mais sans filtre dédié Ha, faudra pas être trop exigeant, surtout en Bortle 7 et avec la Lune. L’œil humain voit très mal le rouge déjà pour commencer, c'est pour cette raison qu'on fait du SHO et qu'on met le H non pas dans le rouge mais dans le vert. La même image que celle en N&B plus haut mais cette fois en HOO (le H dans le rouge donc) : Et voici maintenant la même image mais cette fois traitée en HHO (le H dans le rouge et dans le vert) : Cette image a été réalisée non pas sous un bon ciel, mais à 3km du périph nord parisien Mais évidemment là c'est le L-Extrême qui fait des miracles ! La même image avec le L-Pro n'aurait certainement rien donné de probant.

-

Salut, plusieurs explications sont nécessaires. Déjà un L-Pro c'est un filtre anti-pollution, pas un filtre Ha-pass. Par conséquent t'auras pas plus de halpha qui sortira avec ce filtre que sans filtre, juste un fond de ciel un peu plus noir. Pour sortir du Ha il faut un filtre dual-band type L-Extrême (voir mon article sur les filtres en signature). Ensuite tu n'as pas correctement cadré NGC7000 là, regarde où tu es : Et pour comparer, un champ réalisé au L-Extrême sur ma 106, on voit le "boomerang" sur les deux images, mais ton champ est trop réduit pour qu'on comprenne bien qu'on est sur America.

-

Voilà ce que c'est que de lire trop rapidement les posts Faudra m'expliquer comment tu la mets ton eau dans une batterie au gel vu qu'elle est étanche Ben si le niveau est vraiment très bas, rajouter juste de l'eau ne suffit plus. Maintenant comme Pyrou l'a précisé ensuite, certains éléments ne sont pas noyés, donc on est encore loin du niveau bas => eau distillée suffit

-

améliorer un doublet achromatique pour le H alpha

Colmic a répondu à un sujet de Tyler dans Matériel général

Salut, c'est un LS35 ancienne génération avec l'étalon devant l'objectif ? Dans ce cas l'étalon est sensé fonctionner avec les rayons parallèle, soit F/30 minimum. Si tu veux le monter à l'arrière de la 70/500 il va donc déjà falloir la passer à F/30 pour commencer. Si c'est un nouveau modèle avec étalon arrière, alors il est sensé travailler à F/7 (les PST travaillent eux à F/10). On a déjà fait des modifs avec des étalons arrière de LS50, ça fonctionne très bien à F/7 sans rien modifier. En revanche pour un étalon avant, faut poser la question à Beloptik. Les BF Coronado fonctionnent très bien sur un étalon Lunt, en revanche moi j'avais acheté un BF1800 Lunt pour le monter derrière l'étalon de mon PST, l'image était dégueulasse, je l'ai rendu pour prendre un BF15 du coup. -

Ah ben si c'est 13.46V en fin de charge ça va alors. Regarde les niveaux et au besoin remet de l'eau (attention pas d'eau du robinet hein ! Il faut de l'eau distillée) ou alors directement de l'électrolyte en bidon.

-

Le croissant: 20min en Ha avec l'Antlia 3um, ça promet !

Colmic a répondu à un sujet de JMDSomme dans Astrophotographie

Salut, elle est très bien la HOO, mais pour info le croissant n'a strictement rien en soufre, que dalle, nada ! Donc SHO aucun intérêt sur cette cible -

Matériel reset intempestif au changement de cible de ASIAIR PRO 1.9 (953) ?

Colmic a répondu à un sujet de antoinebba dans Astrophotographie

Bonjour, je t'invite à reposer ta question sur le topic dédié de l'ASiair (lien dans ma signature). Tu auras sans doute plus de réponses.