-

Compteur de contenus

993 -

Inscription

-

Dernière visite

-

Jours gagnés

5

Type de contenu

Profils

Forums

Téléchargements

Blogs

Boutique

Calendrier

Noctua

Tout ce qui a été posté par keymlinux

-

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

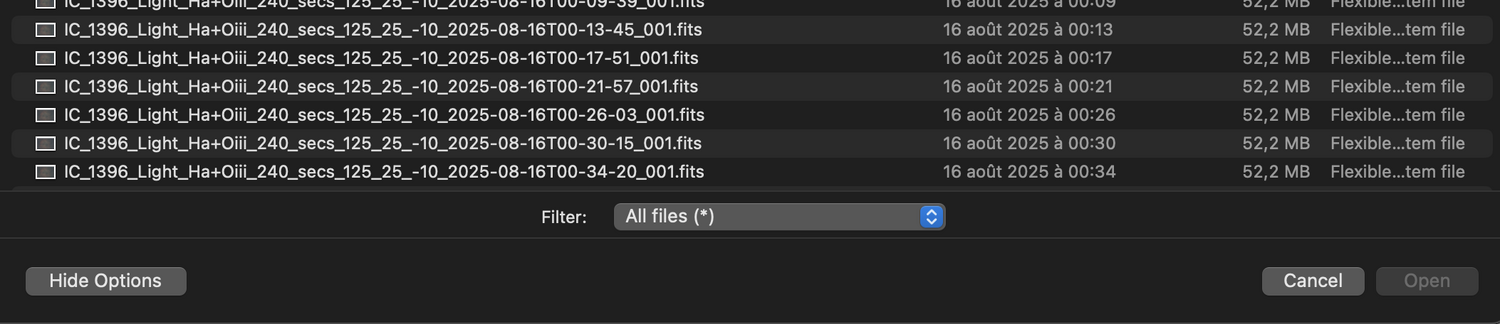

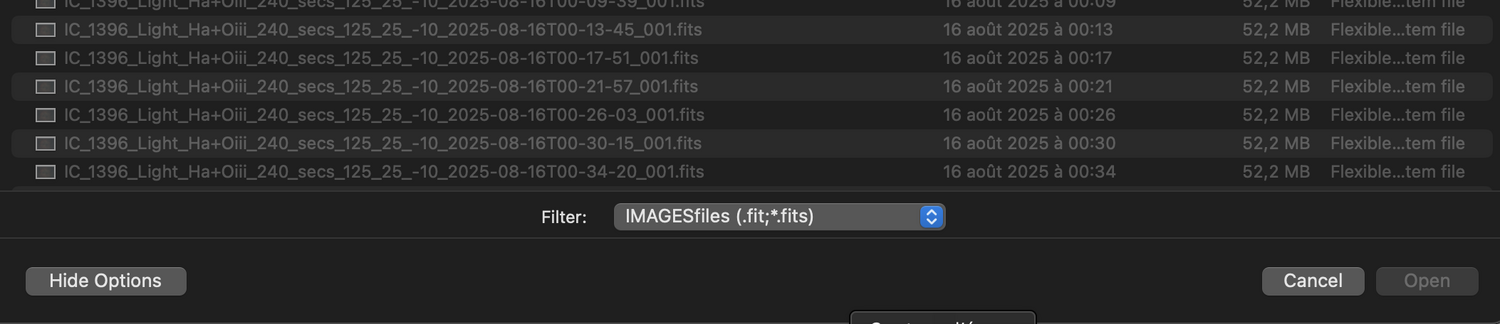

J'ai testé la RC3 - j'ai toujours le soucis dans la fenêtre de mise à jour de la session (bouton update), le champ session name reste vide et le nom de la session apparait dans le champ session number (voir copie d'écran dans mon poste précédent) - pour ls autres soucis c'est OK Par contre quelques autres soucis détectés: - la fenêtre du débugueur pas à pas n'est pas redimensionnable (à moins que cela ne soit par par choix) - dans l'éditeur de script, les numéros de ligne ne sont pas liés au texte (je peux faire defiler (avec l'equivalent de la molette de la souris) la colonne des numéros de lignes séparément à la colonne qui contient le code. Si on utilise l'ascenseur à droite cela fait defiler le code seulement. - dans le même éditeur de script, la fonction "go" pour aller à un numéro de ligne semble ne pas fonctionner EDIT: autre soucis lors de l'ajout de fichier à une session, aucun problème si on fait du drag&drop par contre si on "browse" des repertoires pour sélectionner des fichiers, avec la paternité de recherche par défaut "*.fit;*.fits" cela ne permet pas la selection des fichiers concernés (les fichiers .fits sont grisés), je doit sélectionner le pattern "*.*" pour les dégriser et les selectionner Ci dessous fichiers non sélectionnables et sélectionnables avec le paternel *.* Cordialement -

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

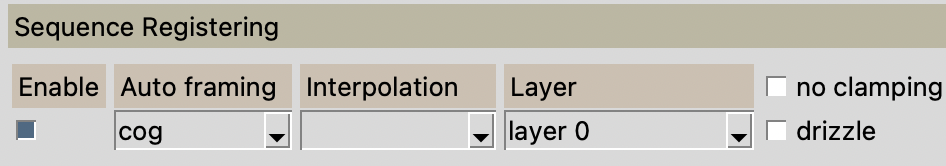

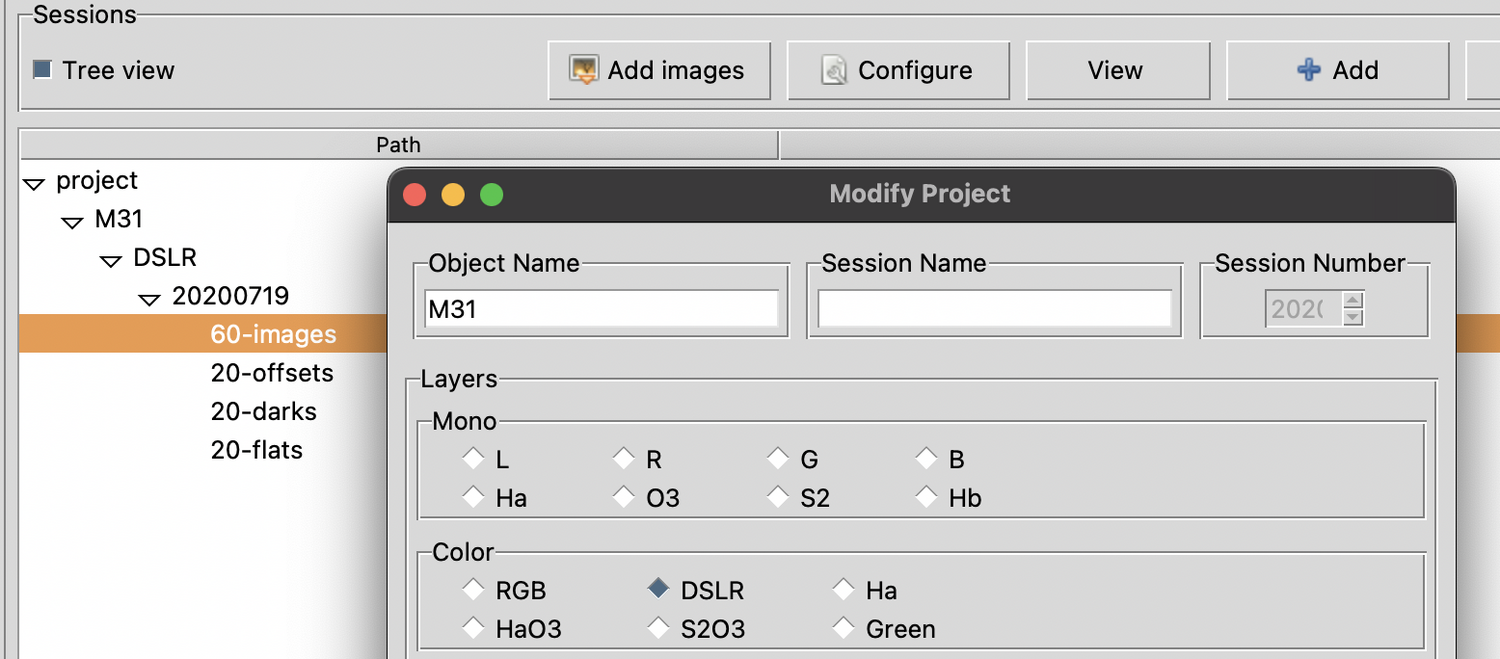

Joyeux Noël 🎁 Bon OK, ce n'est pas le jour pour debuguer des scripts, mais bon, on s'occupe un peu... J'ai testé la nouvelle version. Merci pour la correction des soucis précédents. J'ai noté 3 (nouveaux) soucis (script expert) 1) dans la configuration de la session, partie "more properties", si on enable l'option "sequence registering", même si on ne coche pas l'option drizzle celle ci est ajoutée en paramètre dans le script ce qui est généré dans le script: seqapplyreg bkg_pp_images -drizzle -framing=cog -layer=0 d'où une erreur lors de l'execution du script (je peux fournir tout le script si besoin et le fichier projet) 9:54:54: seqapplyreg bkg_pp_images -drizzle -framing=cog -layer=0 19:54:54: Exécution de la commande : seqapplyreg 19:54:54: Cette séquence n'est pas monochrome / CFA, Drizzle impossible. 19:54:54: L'exécution de la commande a échoué : arguments non valide. 19:54:54: Abort : Command 'seqapplyreg bkg_pp_images -drizzle -framing=cog -layer=0' failed: Argument error 19:54:54: seqapplyreg bkg_pp_images -drizzle -framing=cog -layer=0 2) si j'affiche les sessions en mode "treeview" lorsque je sélectionne le bouton "update" pour modifier une session, le nom actuel de la session n'apparait pas dans le champ "nom" mais dans le champ "sequence number" Si par contre je ne suis pas en mode "Treeview", lorsque je sélectionne la session et que j'utilise le bouton "Update", j'ai le message d'erreur suivant (je pense que ici aussi c'est du au fait que mon nom de session ne contient que des chiffres et est identifié comme étant un "int" et pas un "str") 0:10:45: Exception in Tkinter callback 20:10:45: Traceback (most recent call last): 20:10:45: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 20:10:45: return self.func(*args) 20:10:45: ^^^^^^^^^^^^^^^^ 20:10:45: File "/Users/stephane/Downloads/App/sirilic/Expert.py", line 114, in cbUpdate 20:10:45: if re.search(r'\d+$',session_no) : 20:10:45: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 20:10:45: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/re/__init__.py", line 177, in search 20:10:45: return _compile(pattern, flags).search(string) 20:10:45: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 20:10:45: TypeError: expected string or bytes-like object, got 'int' 3) J'ai testé le mode pas à pas pour le lancement du script. A priori sur MacOs le click droit pour changer le statut d'une ligne n'est pas détecté (sachant qu'avec le trackpad d'un macbook le click gauche se fait en tapant avec 1 doigt et le click droit avec 2 doigts) Je pense que le problème ici est plus lié au code du module "Tkinter" qui gère l'interface graphique qu'à ton propre code. Cordialement, Stéphane -

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

A priori value est une chaîne de caractère vide, pourtant en mode "treeview" je sélectionne bien le nom de session avant de cliquer sur un bouton Configure/View 8:01:04: Begin: Sirilic() 18:01:05: wd: /Users/stephane/Pictures/Demo Siril 18:01:05: configdir: /Users/stephane/Library/Application Support/org.siril.Siril/siril 18:01:05: get_siril_userdatadir: /Users/stephane/Library/Application Support/org.siril.Siril/siril 18:01:05: get_siril_systemdatadir: /Applications/Siril.app/Contents/Resources/share/siril 18:01:16: type: <class 'str'> , value= 18:01:16: Exception in Tkinter callback 18:01:16: Traceback (most recent call last): 18:01:16: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 18:01:16: return self.func(*args) 18:01:16: ^^^^^^^^^^^^^^^^ 18:01:16: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 188, in cbView 18:01:16: (object,layer,session) = shdata.root.fs.GetSelection() 18:01:16: ^^^^^^^^^^^^^^^^^^^^^^ 18:01:16: ValueError: not enough values to unpack (expected 3, got 0) -

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

même message d'erreur -

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

J'obtiens alors le message suivant (valable avec View et avec Configure) 5:27:47: Exception in Tkinter callback 15:27:47: Traceback (most recent call last): 15:27:47: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 15:27:47: return self.func(*args) 15:27:47: ^^^^^^^^^^^^^^^^ 15:27:47: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 188, in cbView 15:27:47: (object,layer,session) = shdata.root.fs.GetSelection() 15:27:47: ^^^^^^^^^^^^^^^^^^^^^^ 15:27:47: ValueError: not enough values to unpack (expected 3, got 0) -

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

3 autres soucis 1) dans les options (bouton configure) lorsque je coche l'option pour soustraire les biases au flats, cela ne génère pas l'option voulue dans le script et cela ne modifie rien dans la vue graphique (bouton view), les biases sont empilés mais non utilisés EDIT: Correction: l'option est bien prise en charge pour le script, mais j'avais oublié de faire "rebuild". Seule la fenêtre de "vue graphique" du process est affectée 2) pour utiliser les boutons configure et view, il faut avoir sélectionné une session, mais cela ne fonctionne pas is on a coché l'option de vue arborescente (tree view), on a alors l'erreur suivante: 5:05:30: Exception in Tkinter callback 15:05:30: Traceback (most recent call last): 15:05:30: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 15:05:30: return self.func(*args) 15:05:30: ^^^^^^^^^^^^^^^^ 15:05:30: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 188, in cbView 15:05:30: (object,layer,session) = shdata.root.fs.GetSelection() 15:05:30: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 15:05:30: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 268, in GetSelection 15:05:30: value = value[0].split("/") 15:05:30: ~~~~~^^^ 15:05:30: IndexError: string index out of range EDIT: 3) lors de l'utilisation du bouton "update" pour mettre a jour la session, ici aussi je pense que cal est du au fait que le nom de session que j'utilise ne contient que des chiffres et est interprété comme un entier et pas une chaîne 5:14:31: Exception in Tkinter callback 15:14:31: Traceback (most recent call last): 15:14:31: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 15:14:31: return self.func(*args) 15:14:31: ^^^^^^^^^^^^^^^^ 15:14:31: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 106, in cbUpdate 15:14:31: if re.search(r'\d+$',session_no) : 15:14:31: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 15:14:31: File "/Applications/Siril.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/re/__init__.py", line 177, in search 15:14:31: return _compile(pattern, flags).search(string) 15:14:31: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 15:14:31: TypeError: expected string or bytes-like object, got 'int' -

Sirilic 2.0.0 Release Candidate 1

keymlinux a répondu à un sujet de m27trognondepomme dans Logiciel SIRILIC de Siril et Sirilic

Salut, Je viens de faire quelques test sur MacOS Pas de problème de déploiement, 1er lancement avec chargement des paquets de dépendance OK L'interface s'affiche sans soucis graphiques. La génération de script et l'éditeur de script sont OK note: je precise cela car ce sont des éléments où nous avions rencontré des problèmes spécifiques à l'environnement MacOS par le passé. Les soucis: Lors de la creation d'un nouveau projet, lorsque je souhaite ajouter des images j'ai le message suivant (lors du click bouton Add images) 10:44:40: Exception in Tkinter callback 10:44:40: Traceback (most recent call last): 10:44:40: File "/Applications/Siril-1.4.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 10:44:40: return self.func(*args) 10:44:40: ^^^^^^^^^^^^^^^^ 10:44:40: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 233, in cbAddImages 10:44:40: keystr = shdata.idb.KeyStr(object,layer,session) 10:44:40: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 10:44:40: File "/Users/stephane/Downloads/App/sirilic/lib/database.py", line 140, in KeyStr 10:44:40: return ObjectName + KwKeyStr + LayerName + KwKeyStr + SessionName 10:44:40: ~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~^~~~~~~~~~~~~ 10:44:40: TypeError: can only concatenate str (not "int") to str Si je charge un projet existant (avec des images déjà déclarées), j'ai un message similaire lorsque je clique sur le bouton "configure" 10:42:36: Exception in Tkinter callback 10:42:36: Traceback (most recent call last): 10:42:36: File "/Applications/Siril-1.4.app/Contents/Frameworks/Python.framework/Versions/3.12/lib/python3.12/tkinter/__init__.py", line 1968, in __call__ 10:42:36: return self.func(*args) 10:42:36: ^^^^^^^^^^^^^^^^ 10:42:36: File "/Users/stephane/Downloads/App/sirilic/sirilic.py", line 203, in cbConfigure 10:42:36: keystr = shdata.idb.KeyStr(object,layer,session) 10:42:36: ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ 10:42:36: File "/Users/stephane/Downloads/App/sirilic/lib/database.py", line 140, in KeyStr 10:42:36: return ObjectName + KwKeyStr + LayerName + KwKeyStr + SessionName 10:42:36: ~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~^~~~~~~~~~~~~ 10:42:36: TypeError: can only concatenate str (not "int") to str EDIT: comme mon nom de session est "20200719" et ne contient que des chiffres et pas de lettre, je pense qu'il traite cela comme un entier et pas comme une chaîne, d'où l'erreur lors de la concatenation de chaîne EDIT2: du coup en remplaçant (dans database.py) return ObjectName + KwKeyStr + LayerName + KwKeyStr + SessionName par return ObjectName + KwKeyStr + LayerName + KwKeyStr + str(SessionName) cela fonctionne Cordialement -

EAF : marques ? Avis ? Conseils ?

keymlinux a répondu à un sujet de lionthom dans Matériel astrophotographique

Oui, le port a un format usb-C mais en terme de protocole/débit cela sera de l'USB 2.0 EDIT: d'ailleurs dans la boite P.O a aussi mis 2 petits cables USB 2.0 de 50cm, un usb-c/usb-c et un usb-c/usb-b qui sont justement fait pour brancher un autre périphérique en mode chainé sur le port "device" de la camera -

EAF : marques ? Avis ? Conseils ?

keymlinux a répondu à un sujet de lionthom dans Matériel astrophotographique

Bonjour, Sur la caméra poseidon-c il y a un ports usb pour brancher un autre périphérique. Certes il est en usb-c, mais l’eaf-n aussi, et pour un focuser conçurent avec prise usb-a, avec un adaptateur usb-c mâle vers usb-a femelle tu dois pouvoir connecter. note: j’ai un eaf gen1 avec alim12v, donc non concerné par ton problème pour alimenter en usb. l’eaf a certes du backslash mais cela ne ma jamais posé problème, la plupart des softs de mise au point gèrent bien cela (kstars/ekos/indi en ce qui me concerne) Sinon tu peux aussi migrer vers un hub usb alimenté, comme cela cela ne vas pas tirer sur le port usb de la tablette Cordialement -

Quel objectif très grand angle/FISHEYE vous conseillez ?

keymlinux a répondu à un sujet de cmltb612 dans Astrophotographie

Bonjour, Il y a un objectif Laowa 11mm f2.8 disponible en monture RF mais avec mise au point manuelle seulement (en RF Canon ferme les spécifications pour l'autofocus pour les optiques de fournisseurs tiers, mais l'usage de connectivité physique de la baïonnette RF n'est pas interdite) https://laowa.fr/ultra-grand-angle/117-457-10mm-f28-zero-d-ff.html#/41-monture-canon_rf/73-mise_au_point-manuelle_mf De plus les objectifs tiers en monture EF devraient (usage du conditionnel) fonctionner avec l'adaptateur RF-EF, y compris pour l'autofocus --> as tu testé des objectifs tiers EF avec adaptateur RF-EF ? note: ma question n'est pas totalement désintéressée, je compte acquérir un Canon FF à monture RF, je compte utiliser un adaptateur RF-EF pour quelques objectifs Canon et Sigma que j'ai déjà en monture EF... Cordialement, Stéphane -

Salut @gregastro, tu as fait un bon choix pour la P.O Poseidon-C Histoire de ne pas encombrer le forum qui manque de place en ce moment, je ne reposte pas les images, mais voici les liens sur les post où j'ai mis mes images faites avec cette caméra Cordialement, Stéphane

-

Setup samyang 135 F2 canon ef-m et asi 1600 pro ?

keymlinux a répondu à un sujet de antoinebba dans Matériel astrophotographique

La camera asi1600 pro a un backfocus de 17.5mm avec sa bague d'adaptation, mais effectivement elle peut être enlevée pour obtenir un backfocus de 6.5mm (on passe alors d'un filetage M42 femelle à M42 mâle) Avoir un objectif photo a monture EF ou EF-S + adaptateur Canon vers M42 + roue a filtre (M42 femelle de chaque coté) + ASI1600 est possible. C'est décrit dans la doc de l'ASI1600, schéma page 14 de la doc ci dessous https://i.zwoastro.com/zwo-website/manuals/ASI1600_Manual_EN_V1.5.pdf Si ta camera est monochrome (ASI1600MM) alors la roue a filtre se justifie, mais si ta camera est couleur (ASI1600MC), moi a ta place je me passerais de roue a filtre et j'utiliserais un diviseur optique a la place (sauf a vouloir faire du SHO avec des filtres dual-band) L'objectif Samyang 135mm F2 est a mise au point manuelle, donc c'est motorisable avec un EAF et une courroie type GT2 (les courroies crantées utilisées su rue imprimantes 3D). Reste à trouver un dispositif pour le fixer sur cet objectif et bonne nouvelle, en faisant une recherche sur le net je suis tombé sur le sujet suivant: Cordialement -

Salut @norma, un beau projet en perspective. J'espère que tu a pris soin de mettre des repères sur la tranche des lentilles pour les remonter avec le même alignement, et de récupérer les éventuelles cales qui séparaient les 2 lentilles.

-

Setup samyang 135 F2 canon ef-m et asi 1600 pro ?

keymlinux a répondu à un sujet de antoinebba dans Matériel astrophotographique

Bonjour, Les APN Canon "EOS M" qui utilisent des objectifs a monture EF-M ont un format de capteur de type APS-C, qui est plus grand que la capteur 4/3 de l'ASI 1600. Donc ce type d'objectif est capable de bien illuminer le capteur de ta camera (un objectif capable de produire un cercle d'image bien corrigé pour un capteur de 30mm de diagonale le fera très bien aussi sur un capteur de seulement 22mm de diagonale) Par contre ces mêmes objectifs Canon EF-M disposent d'un tirage optique de 18mm (bien plus court que les objectifs Canon EF et EF-S qui ont un tirage optique de 44mm) Cela signifie que le capteur de ta camera devra être positionné 18mm derrière l'objectif (distance comptée à partir de la surface de contact de la monture, pas à partir de l'extrémité de la baïonnette qui rentre dans le boitier de l'APN). Ta camera, l'ASI 1600 pro a un tirage optique de 17,5mm. Désolé mais je ne vois pas comment il va être possible d'avoir un adapteur de seulement 0.5mm entre la baïonnette format EF-M et le pas de vis M42 de la camera Avec un objectif EF ou EF-S qui a un chemin optique de 44mm il resterait 26.5mm (soit 44-17.5), ce qui est suffisant pour intercaler un adaptateur EF-M vers M42 (si tant est qu'un tel adaptateur existe dans le commerce ou que l'on puisse le fabriquer via impression 3D), mais insuffisant pour une roue a filtre (souvent 20mm de large) et un OAG (souvent 15mm de large) Cordialement, Stéphane -

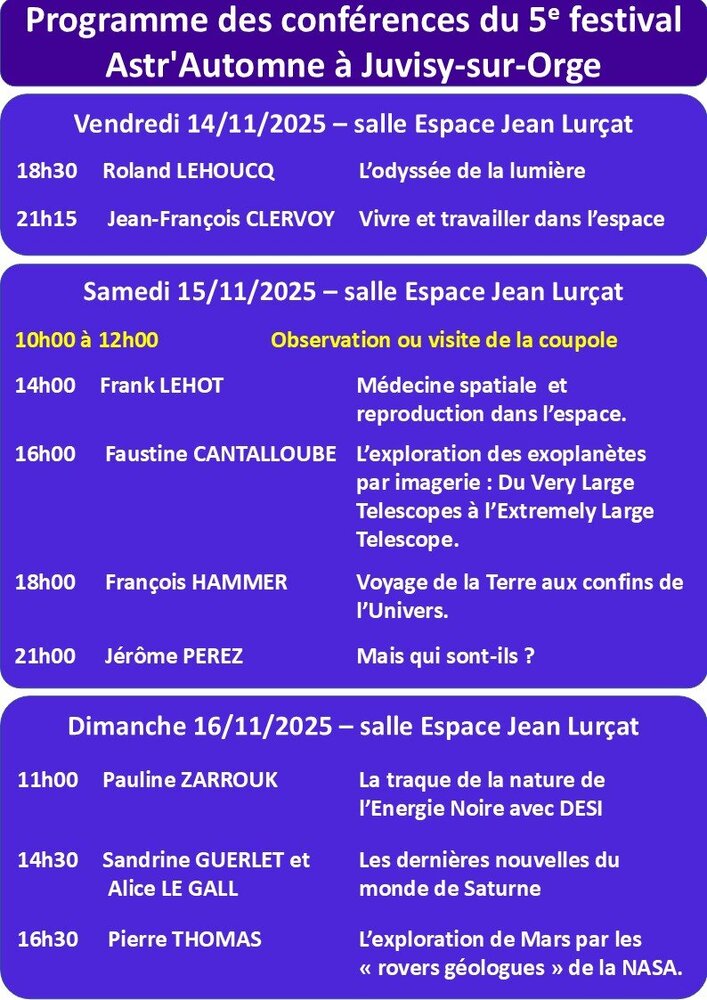

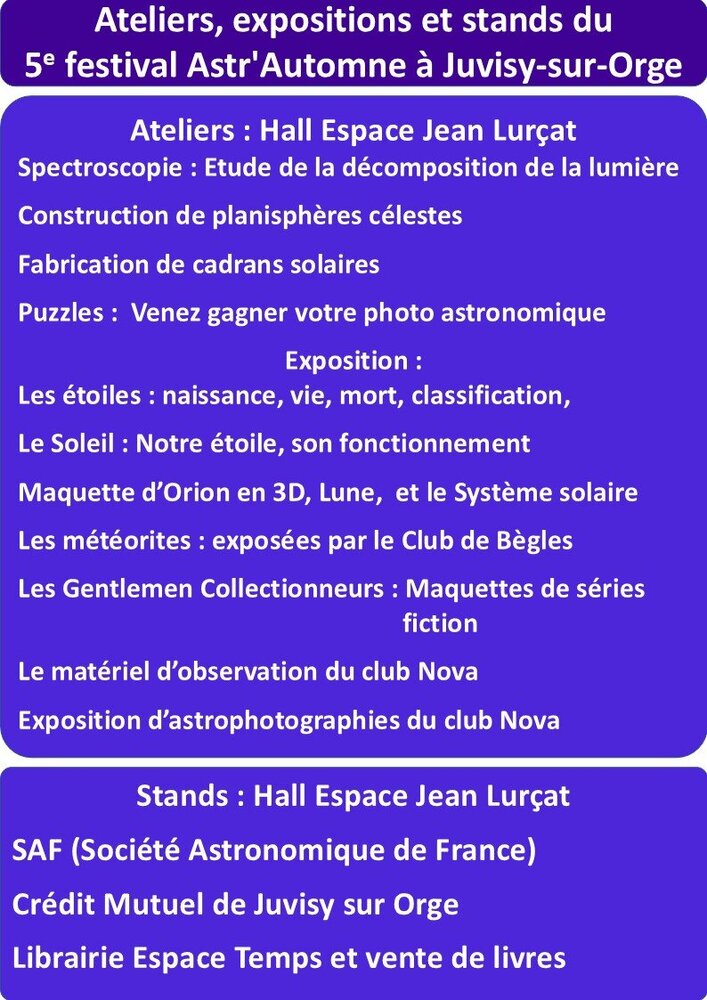

Bonjour à tous, Si vous ne savez pas quoi faire le weekend prochain (du 14 au 16 novembre 2025), le club d'astronomie de Juvisy sur Orge vous invite à venir découvrir la 5eme édition de son festival "Astr'automne" (voir affiche et programme ci dessous) Vu que weekend s'annonce pluvieux (en tout cas en région parisienne), et que vous êtes condamnés à annuler vos sorties d'observation ou d'astrophoto, profitez en pour passer nous voir, pour discuter de tout, mais surtout d'astronomie Perso vous pourrez me croiser sur le stand "spectroscopie" Cordialement, Stéphane

-

- 2

-

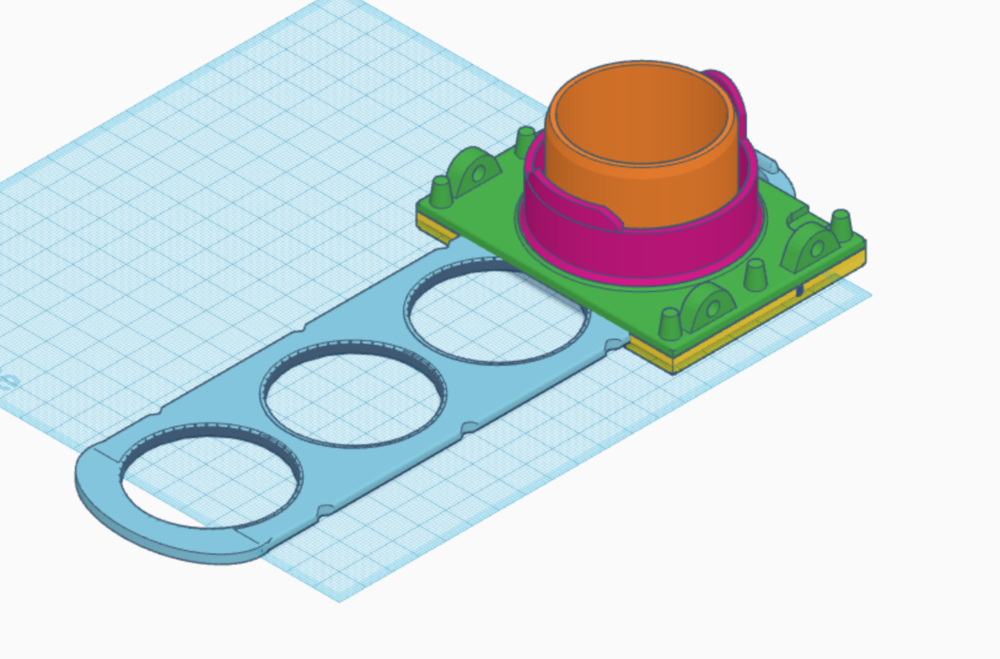

-

Dans l'image ci dessous - le tube du porte oculaire coté intérieur du tube optique rentre entre les parties orange et violettes - sur la partie verte, tu peux voir 4 attaches percées qui permettent de fixer le tout a la cage du secondaire (qui est ajouré dans mon cas) avec de la cordelette élastique - la partie bleue, sur laquelle sont fixés les filtres coulisse entre les parties vertes et jaunes Je m'interdit de percer des trous dans mon dobson Mais sur ton Taurus la cage du secondaire est du tube plein, il ne sera effectivement pas facile d'y accrocher qui que ce soit sans perçage/vissage

-

Bonjour, Pour info, dans le sujet ci dessous je présente un porte filtre a glissière que j'avais fabriqué en impression 3D pour mon dobson important: comme le tube du porte oculaire ressort de la cage du secondaire (empiète sur l'intérieur du tube), j'ai du faire un support de filtre qui se fixe dessus (il n'est pas fixé sur la cage du secondaire), avec les photos c'est plus clair...

-

Certes, mais avec l'onduleur qui passe le 12V en 220V, après il faut ajouter le transfo du PC qui convertit le 220V en 19V, et vu la température qu'atteint ce transfo (en tout cas sur mon macbook, peut être pas généralisable) je doute qu'ili ait une efficacité de 98%... Tu me garantit que 12V continu --98%efficace--> 220V alternatif --??%efficace--> 19V continu c'est toujours plus efficace que 12V continu --93%efficace--> 19V continu ?

-

En fait non, pour plusieurs raisons différentes: - pour certains PC c'est 19V, pour d'autres 19,5, etc... souvent entre 19 et 21V (mais tu pourra me dire qu'avec un modele sortant du 12-25 tu pourra lever cette limite) - la plupart des ordi récents veulent "dialoguer" avec leur alim pour réguler la charge (ce qui est devenu la norme pour les smartphone ou plutôt les normes avec des appellations propriétaires telles que "Power Delivery", "Quick Charge" ou encore "Adoptive Fast Charging" Mon ordi étant un macbook équipe d'un connecteur magsafe j'ai opté pour un adaptateur dédié au modèle. Sur les macbook récents alimentés en USC-C, toute alim compatible "Power Delivery" et permettant de sortir l'amperage requis fait l'affaire. Pour les PC c'est un peu la jungle, DELL, HP, Lenovo, autant de modèle que de format de prises et de voltages (là aussi la normalisation récente vers l'USB-C deviens pratique) Ci dessous exemple pour un macbook avec port magsafe (vu le prix on est tenté de le fabriquer sois même ...) https://www.amazon.fr/portatilmovil-chargeur-voiture-MacBook-MagSafe/dp/B07F2HJY5Z/ref=sr_1_11?__mk_fr_FR=ÅMÅŽÕÑ&crid=U1ZPS243NQJ3&dib=eyJ2IjoiMSJ9.jIPOJkl3Qj00ZIjDTg8HTMSnaldLqaZcmtDTBCzNH5V4PcbpwgIq7U4PsuLLAiAecrJUR65NFjT6cHUw4bYJRoZdbHmCGDWnULGq8kLFNsJQeIWg45Wf89g8UQjHURenKheciFSKeHDmtUVoISSo7UMWg6k3WWet8FnEOo3hQoS7oRHaxsqeQY8dfK901R3aKR0NGdS9_suHh9ivcH-9dlZCNn9AQFPNTdJGXEoqu3P2354u-fJjzKf6FOPTlxSPnFpVekav-ui0PsUfZNkrHpMJi1KPip_GtXIZSU8XaDQ.sBwqBHHWN8aB5iQKYLhH0g6_kHAr2ryzuzQCINb9jZM&dib_tag=se&keywords=adaptateur+allume+cigare+macbook+magsafe&qid=1760966706&sprefix=adaptateur+allume+cigare+macbook+magsafe%2Caps%2C79&sr=8-11 Pour ton cas perso et bien cela va dépendre de ton ordi, quel voltage et amperage max il nécessite et surtout si il nécessite un dialogue avec l'alim. Si c'est un pc "à l'ancienne" qui ne nécessite pas de dialogue alors un simple transfo capable de prendre entre 12 et 14V en entrée et sortir entre 18 et 21V en sortie devrait faire l'affaire. A noter que le modèle que tu donne en exemple est annoncé comme prenant entre 10V et 16V en entrée tout en ayant une sortie stable à 19V (reste a voir si le s19V c'est OK pour ton ordi). Il est aussi annoncé comme permettant un débit de 190W, mais comme les ordi portables c'est entre 60 et 90W, pas de risque de trop chauffer (ne pas utiliser un composant à 100% de ses spécifications) Restera ensuite à trouver le bon connecteur. Regarde le détails (photos) du modèle générique ci dessous, cela te donnera une idée de la multitude des connecteurs existants https://www.amazon.fr/Chargeur-Universel-Chromebook-Pavilion-Connecteurs/dp/B0CF54WKQJ/ref=sr_1_7?__mk_fr_FR=ÅMÅŽÕÑ&crid=1LWJT0DJJ4M7D&dib=eyJ2IjoiMSJ9.DhSYOrWipxJz19e6zvOaX1wt78HJfKAMRTOeKtKr_yCQ63HSYYo4FbFs5L9Vj8eWy-JlatuOxnXki30AY7y4DI3rN0IJ0UWs2RyBGe8iq3EJ3KwZJiQj3CeFqr7k0eHku-usMFPnph7Ll6gdPNR8RrrHgDpFQBJlGXsx5M6RTu45PhvXpRyWqS5VDjBttfbcvrsU9BNiwkaXjqPLWiZZz02aWJTmxsD9gVGABbcLiqWbHQou0zNVBInJ8-8t0D4dU43bowQ2RyGgYDN38Simx7eClQymzEcXtPd5yVm15iY.X9nDeVcIl7FcSSKxe0GfLUzXfK4KEbxaM7Cn5UMYc_I&dib_tag=se&keywords=prise+allume+cigare+pc+dell&qid=1760967501&sprefix=prise+alume+cigare+pc+dell%2Caps%2C96&sr=8-7 Cordialement

-

D’où vient ce rayon bleu sur les photos ?

keymlinux a répondu à un sujet de Jahqo dans Support débutants

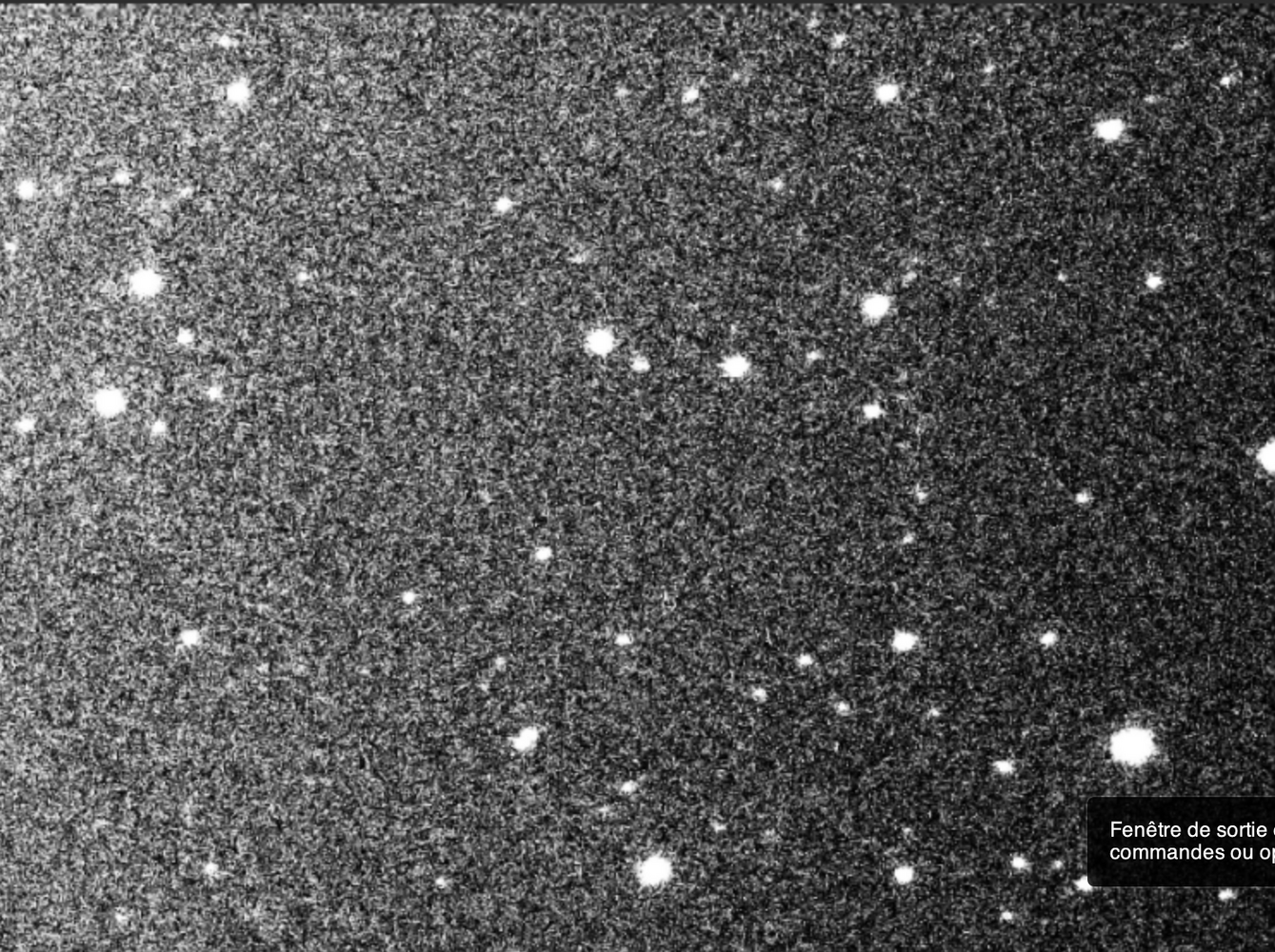

Bonjour, Concernant des derniers darks fournis (fichier unitaire et master). Il sont bien, pas de problème d'homogénéité. note: pour afficher avec des fausses couleurs pour mieux distinguer les dégradés, c'est dans siril, avec les 2 boutons comportant une grosse étoile en bas et au centre de l'interface: l'étoile en noir et blanc permet d'inverser le lumineux/sombre pour avoir un effet "négatif", l'autre étoile en couleur permet d'appliquer des couleurs plus tranchées (les modifications s'appliquent à la visualisation, mais l'image sur laquelle on travaille n'est pas modifiée) Concernant les images brutes, je te confirme que les brutes unitaires font apparaître la trainée bleue partant en diagonale du coté haut-droit de l'image. C'est pas flagrant mais c'est présent. Et comme le signal est présent sur toutes les brutes, plus on en empile et plus cela ressort (l'empilement permet de moyenner le bruit, c'est a dire les éléments non systématiques d'une image à l'autre, pour faire ressortir le signal, c'est a dire les éléments reproductibles d'une image a l'autre, dont cette légère trainée bleue). Ci dessous des captures d'écran des canaux rouges/vert/bleus d'une image light unitaire, zoomé dans l'angle en haut à droite (ouverture du fichier "frame" avec Siril, avec dématricage à l'ouverture, affichage en mode "histogramme" pour exacerber les différences de luminosité Canal rouge Canal vert Canal bleu Donc a priori la diagonale bleue ne viens pas d'un problème de traitement (car présente sur la capture), même si l'empilement la met en valeur (façon de parler...) Cordialement -

Bonjour Raphaël, En ce qui me concerne: - setup a base de AZ-EQ6, camera refroidie, camera de guidage, focuser, résistance chauffante pour la lulu, routeur GL.inet Opal, raspberry pi pour piloter le tout, dongle gps, hub usb - ordi portable (pas utilisé en permanence, juste pour lancer la session + contrôle périodique en cours de session via connection prise en main a distance sur le raspberry pi) Mon premier setup "batterie" était avec une batterie au plomb de 60 Ah. Cela semble beaucoup mais en fait on ne peut (doit) pas tirer plus de 50% de la batterie, et par nuit très froide la batterie plomb montre vite ses limites. Depuis j'ai remplacé la batterie plomb par une Lithium LiFePO4 de 100Ah (que l'on peut consommer à 80%) Bilan: je passe de 30Ah efficace pour 15Kg à 80Ah efficace pour 10 Kg, et j'atteint les 2 nuits d'autonomie (y compris pour les nuits froides et longues de hiver.Pour les nuits d'été je tiens sans problème 4 nuits (le refroidissement de la caméra est plus sollicité, mais pas de résistance chauffante pour la lulu, et souvent la nuit de capture ne dépasse pas 4 heures) Important: j'ai fait le choix de ne pas utiliser le convertisseur 220V, car la transformation 12v-->220V-->12V (pour le matos astro) ou 19V (pour les ordi portables) au final on perd beaucoup d'énergie (transformée en chaleur) Pour alimenter l'ordi j'ai une prise allume-cigare qui convertit du 12V en 19V avec connecteur au format requis pour l'ordi. Pour mon montage batterie voir le post ici: Depuis ce post ce qui a été changé c'est la batterie (de même taille physique) pour passer au Lithium, et l'ajout d'un peu d'isolant pour le froid Cordialement

-

D’où vient ce rayon bleu sur les photos ?

keymlinux a répondu à un sujet de Jahqo dans Support débutants

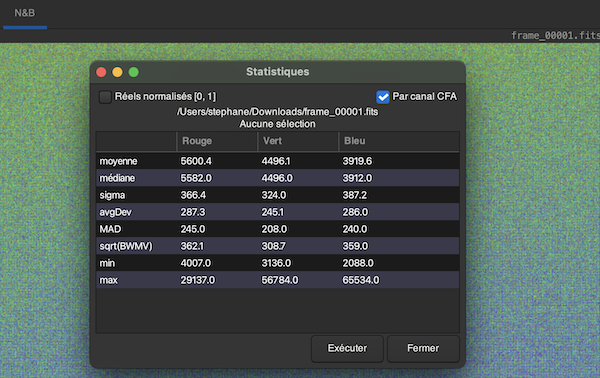

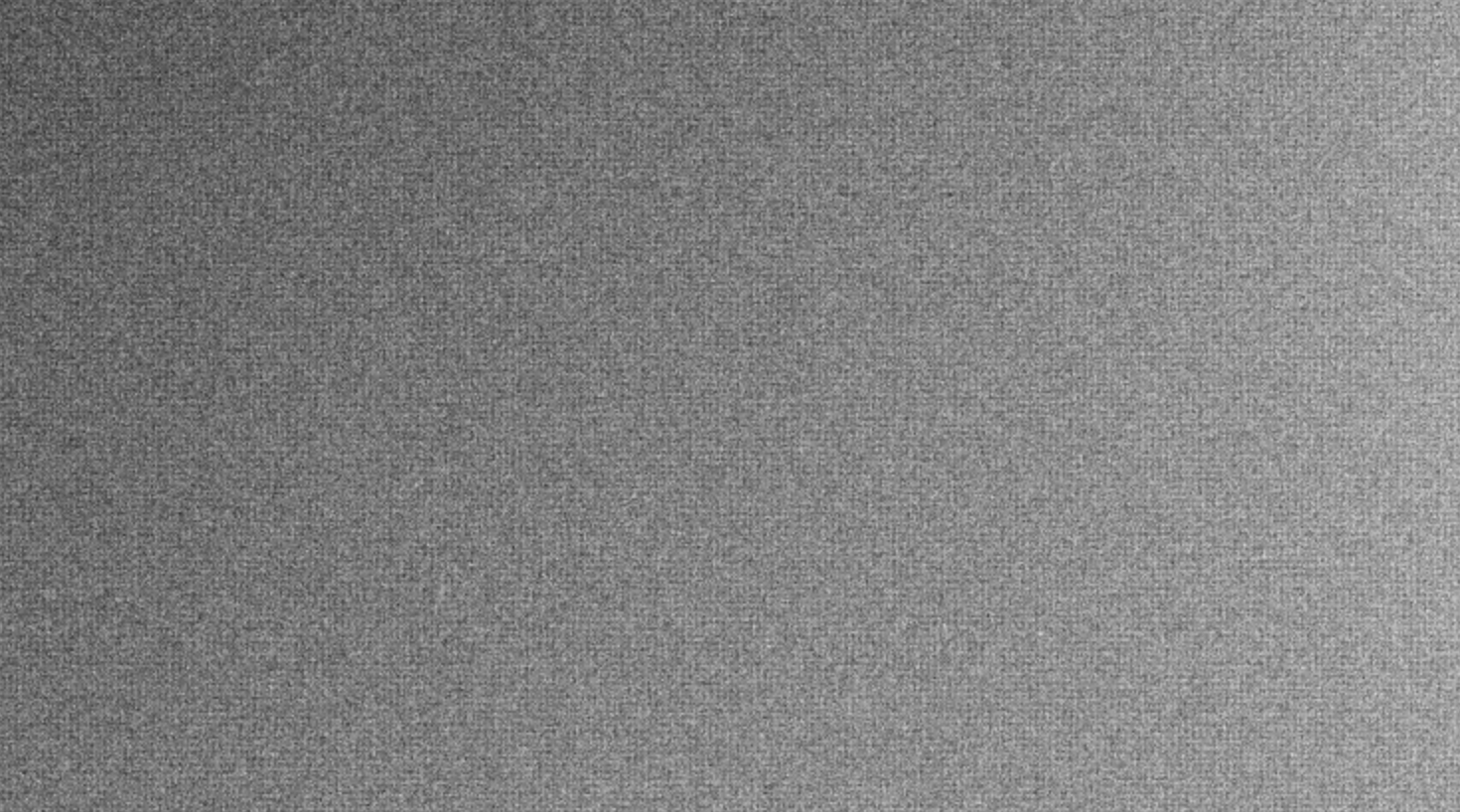

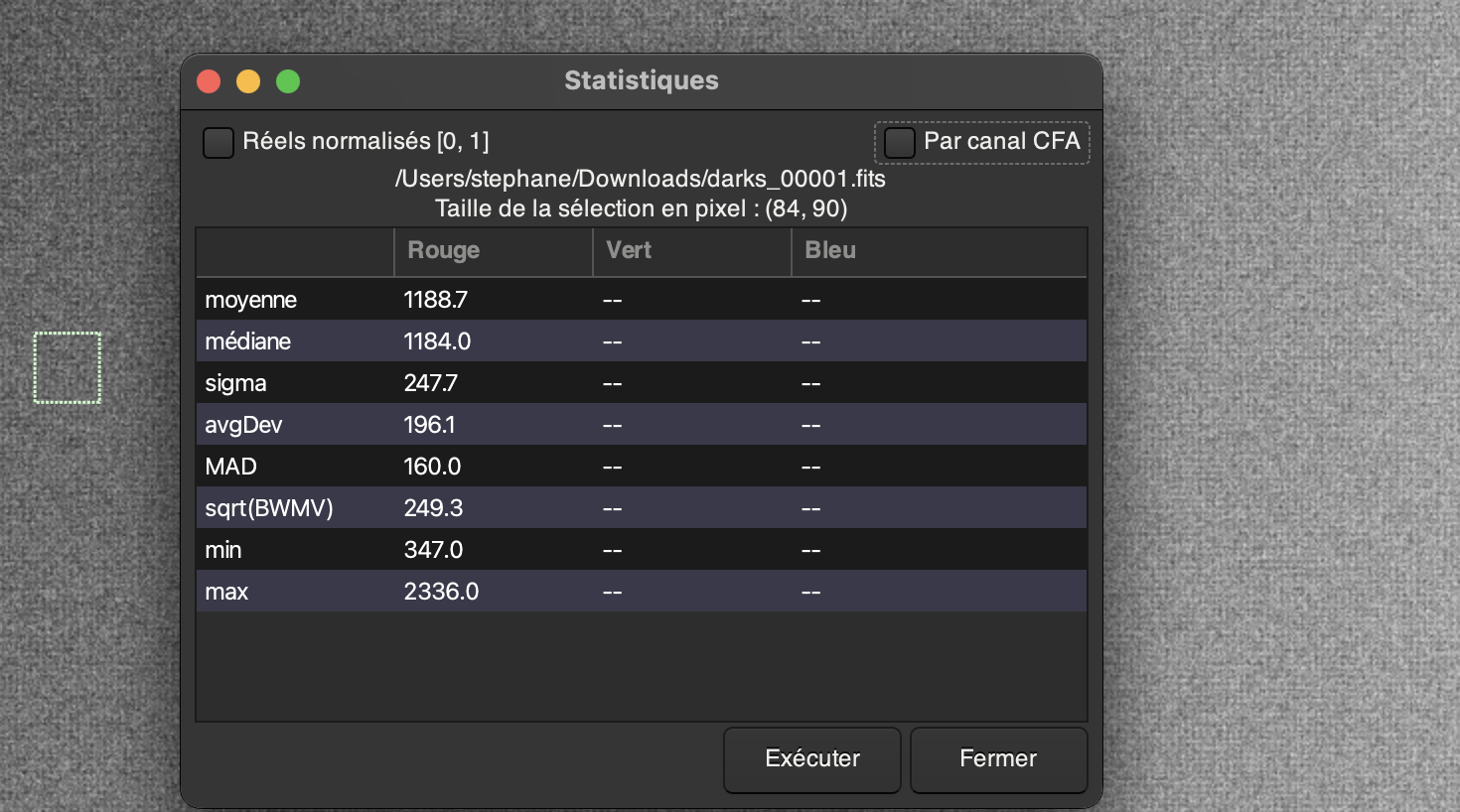

Bonsoir, J'ai un problème avec ton dark (en fait 2 problèmes) 1) il y a un gradient haut/bas (plus lumineux en haut) 2) il présente une luminosité 2 fois supérieure à une "frame" (light) de même exposition Le dark de 30s Le même affichage et calcul de stats pour le light de 30s Le gradient est moins prononcé, mais surtout il y a 2 fois moins de signal !? Et j'ai vérifié les infos dans l'entête fit, les 2 images ont bien 30 secondes d'exposition, avec un gain à 200 et un offset à 0 En passant, ta camera aura un gain optimum à 252, pas à 200 (déclenchement du HCG) De plus l'offset à 0 c'est pas extra, il faut augmenter pour être supérieur à 0 (teste avec 20) Mais bon, vu que ton dark est plus lumineux que ton light j'ai un doute (tu n'aurais pas inverti dark et light ?) Lorsque j'empile les 5 fichiers frame (sans le dark) je ne vois pas de dominante bleu dans le coin... Cordialement -

D’où vient ce rayon bleu sur les photos ?

keymlinux a répondu à un sujet de Jahqo dans Support débutants

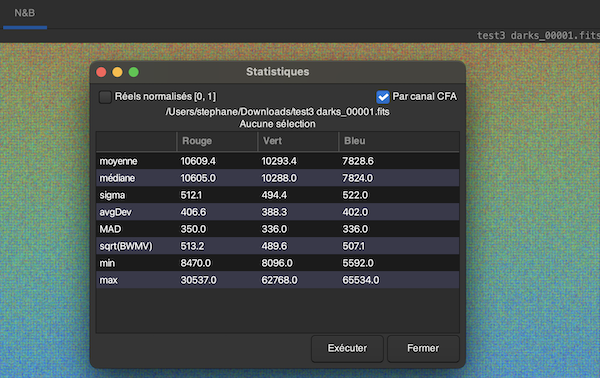

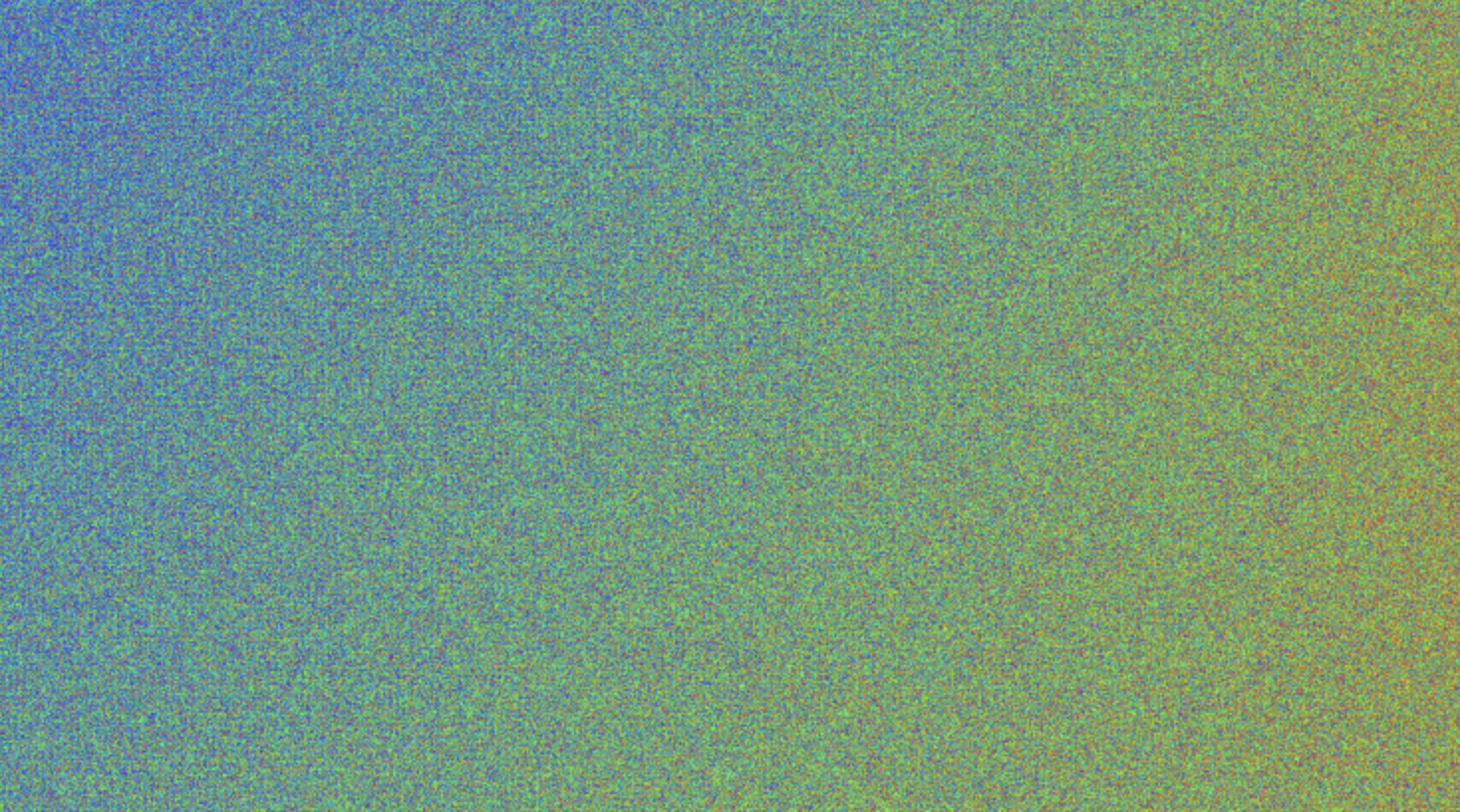

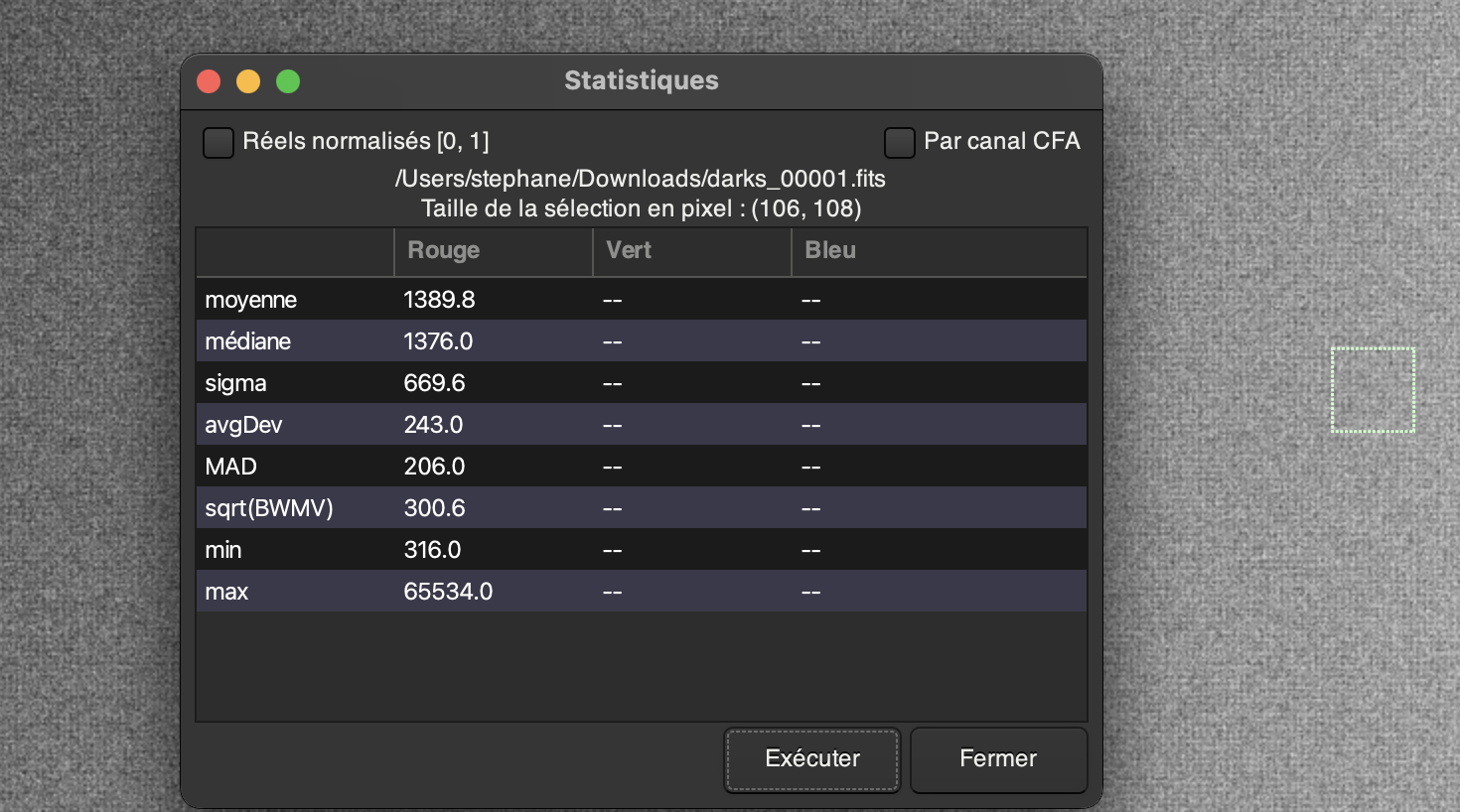

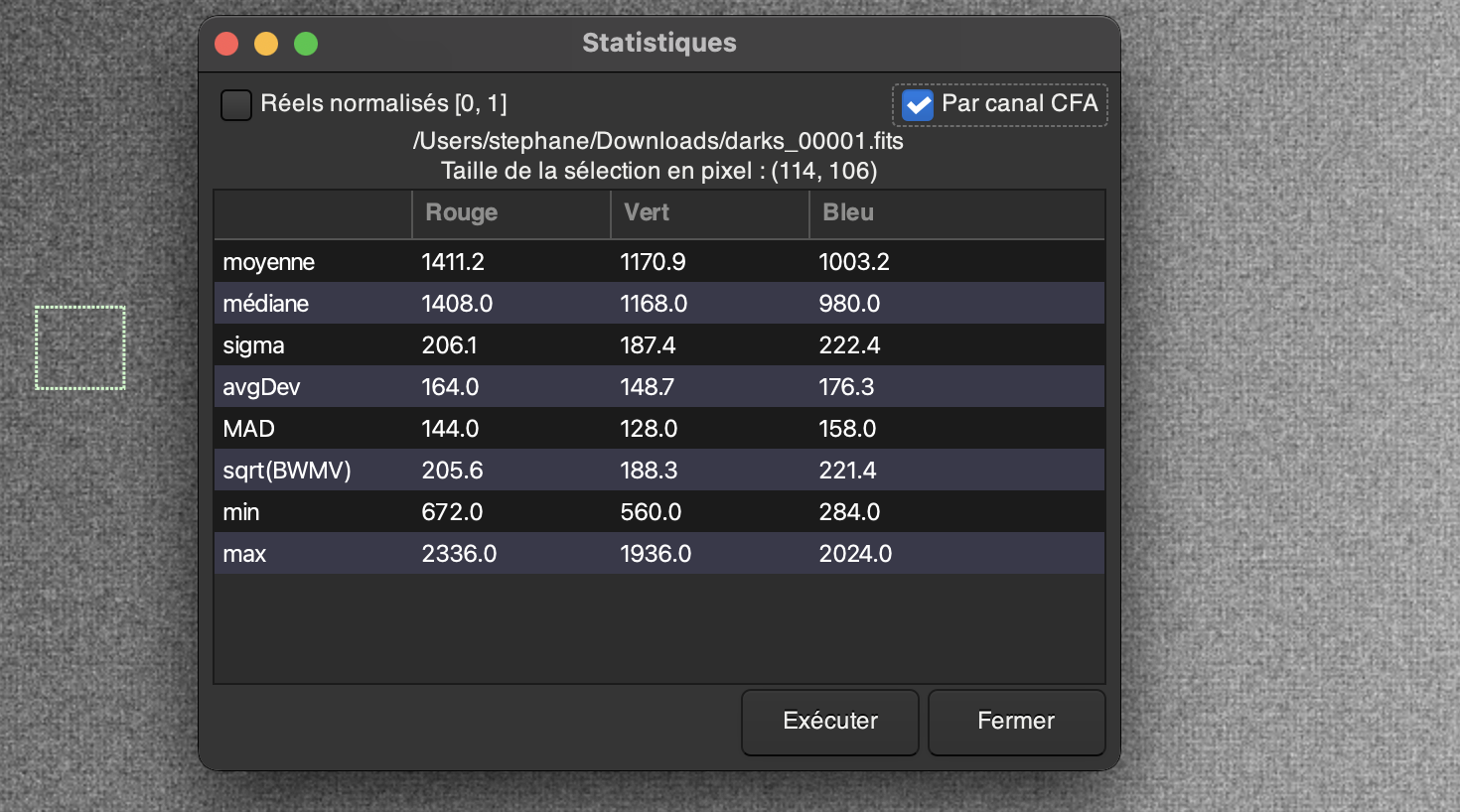

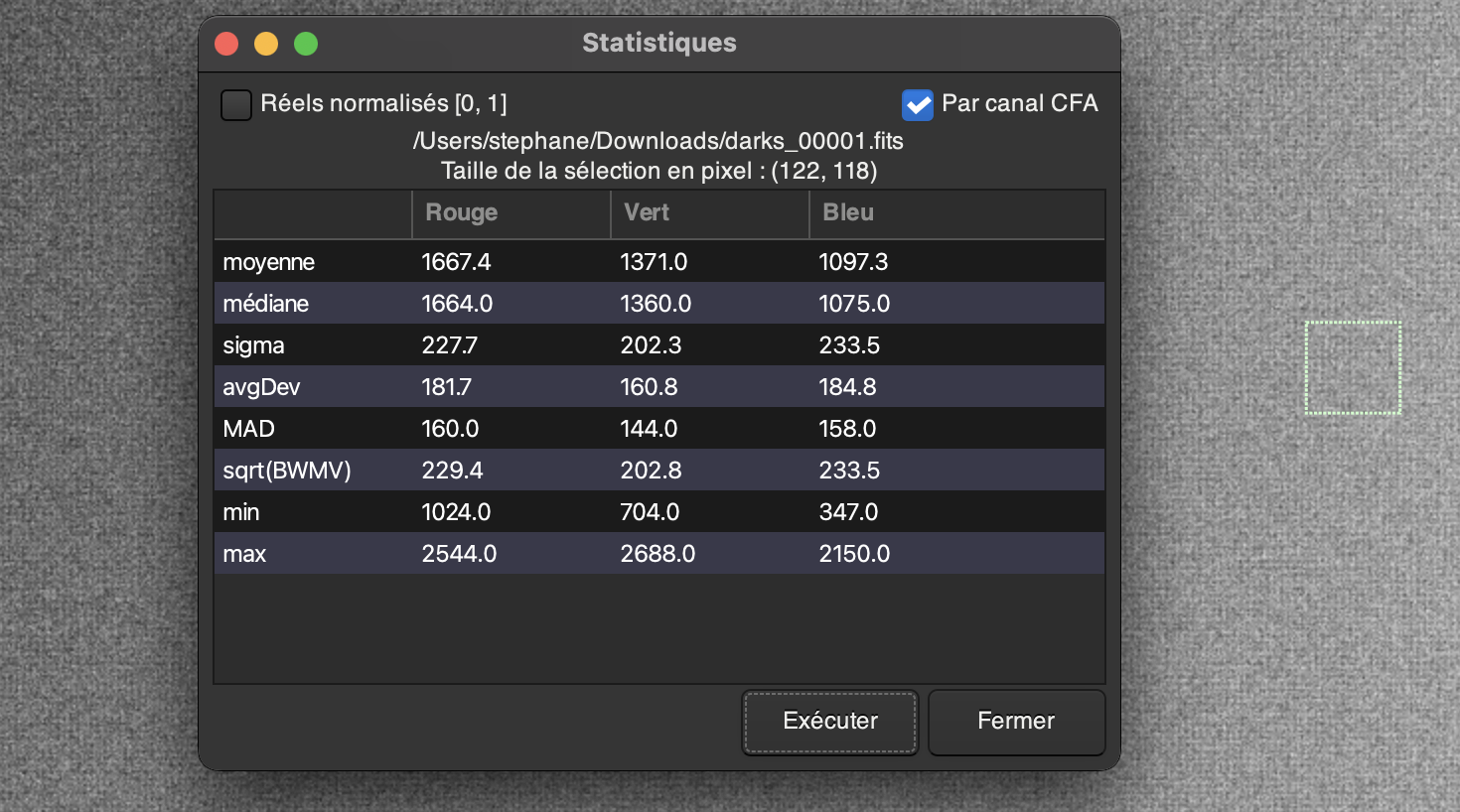

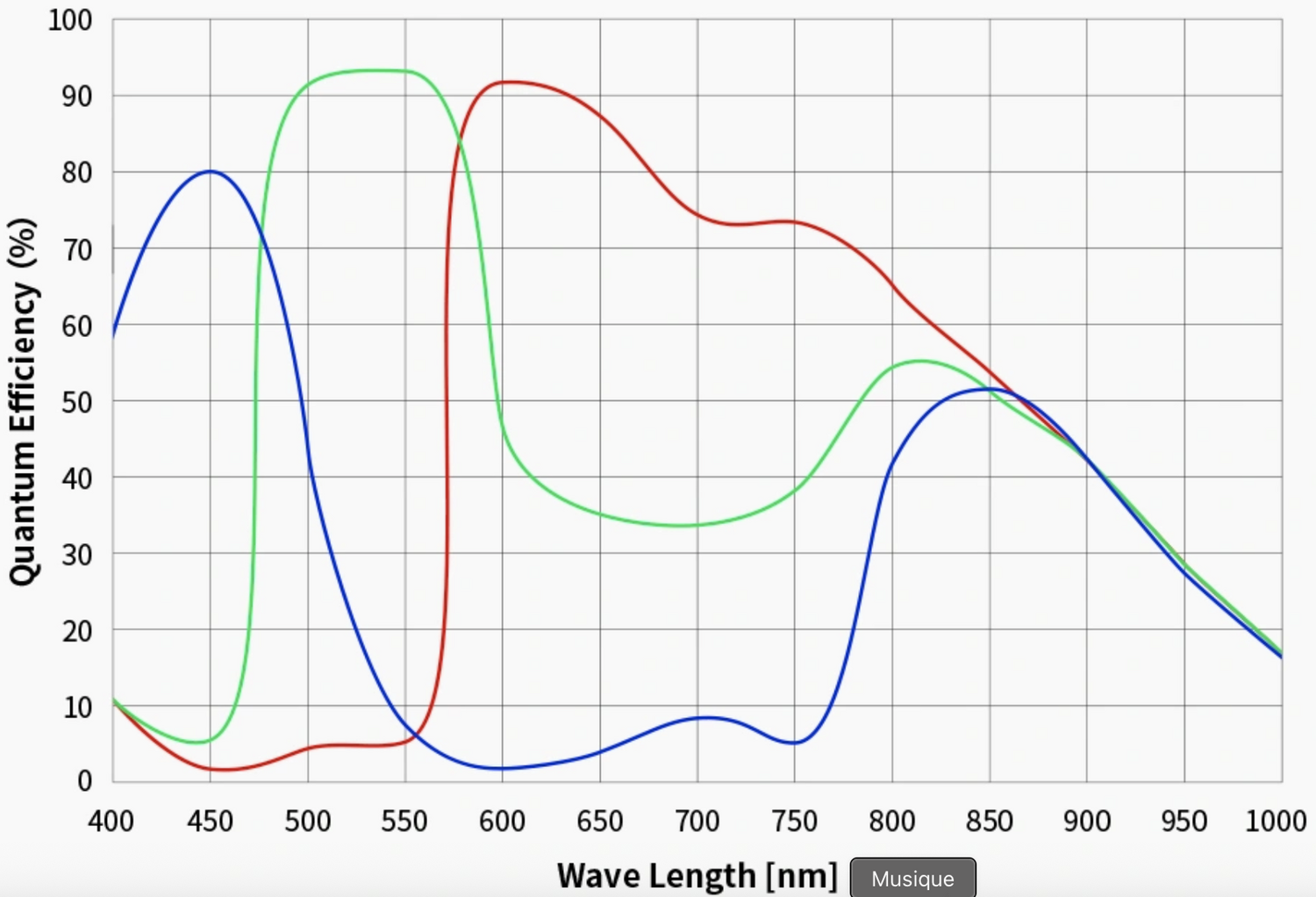

Bonjour, Merci pour le fichier dark. Effectivement sur ce dark on ne voit pas de dominante lumineuse dans la diagonale qui pourrait être a l'origine de la trainée bleue, mais on y voit un autre problème, les détails ont leur importance Procédons a un peu d'analyse avec des détails afin d'être le plus didactique possible. Lorsque j'ouvre le dark avec Siril, sans dématriçage, l'affichage en mode linéaire ne fait rien apparaitre d'anormal (quelques pixels "chauds" isolés (lumineux), mais c'est normal, le dark sert justement à les corriger) Si je passe l'affichage en mode "auto ajustement", déjà je vois un problème, un gradient lumineux apparait (image plus sombre à gauche et plus lumineuse à droite). Mais je vous l'accorde ce n'est pas flagrant, cela dépend beaucoup des capacités de votre ecran Si je passe l'affichage en mode "histogramme" pour accentuer cela deviens flagrant Et en choisissant un affichage en dégradé de couleur c'est encore plus visible Donc on a un gros problème, la caméra ASI662MC est annoncée pour être dépourvue d'ampglow (de plus ce gradient ne ressemble pas à de l'ampglow). D'où viens ce dégradé ? Une analyse un peu plus quantitative, en calculant les statistiques sur une zone à droite et une autre à gauche A gauche de l'image A droite On passe d'une moyenne de 1100 à 1300, près de 20% de signal en plus ! Au passage autre "problème", cette camera est annoncée comme sortant des valeurs sur 12bits, donc des valeurs entre 0 et 4095, pas entre 0 et 65535 --> a priori SharpCap a normalisé les valeurs sur 16bits en enregistrant le fichier fit (personnellement je n'aime pas les softs qui trafiquent les données à mon insu). Mais bon passons sur ce détail (note: je viens de vérifier dans les options de SharpCap, c'est un comportement par défaut, mais il y a une option pour qu'il garde les valeurs d'origine) Si on regarde canal par canal (rouge/vert bleu) pour vérifier si ce gradient est uniforme pour toutes les couleurs ou bien plus prononcé pour une couleur A gauche Le rouge est sur-représenté ! A droite Cela se confirme, il n'y a pas de gradient bleu, mais un peu dans le vert et beaucoup dans le rouge A noter que cette camera à une sensibilité étrange, les pixels vert (ceux qui ont un filtre vert sur la matrice de bayer sont en fait aussi sensible aux longueurs d'onde dans le rouge) La courbe de sensibilité de la camera (source ZWO) Une piste: ta camera est annoncée comme étant sensible dans l'infrarouge. Le hublot devant le capteur est traité anti-reflets mais n'agit pas comme un filtre UV-IR-cut, et il est préconisé d'utiliser ce type de filtre avec cette camera. Tu dis avoir réalisé les dark avec le bouchon de la camera, hors le plastique qui constitue ces bouchons laisse souvent passer pas mal d'infrarouge, ce qui pourrait expliquer la dominante rouge (le gradient pouvant provenir de l'orientation de la camera par rapport à la source infrarouge, comme un radiateur, ou une fenêtre (éclairage du soleil) Comme je le disait, rien avoir avec la dominante bleue en diagonale, je voulais juste montrer 2 choses: 1) tous les détails ont leur importance, et on peut avoir une fuite de lumière même avec le bouchon fermé, si tu utilises ces darks tu va dégrader le résultat 2) disposer des fichiers "raw" en format fit, le plus proche possible de ce qui a été lu sur le capteur permet de faire une analyse quantitative (basée sur la mesure, sur les chiffres) et pas seulement une analyse qualitative (basée sur l'observation ou la description, qui peut être biaisée par exemple par des choix d'affichage ou de calibration d'écran) Désolé, c'était un peu long, et avec tout cela on a pas avancé sur le problème initial As tu un fichier raw (en fit donc) d'une image brute ? (les png ne nous servirons pas). Si c'est le cas merci d'en poster un. Un fichier unitaire, pas un empilement, comme cela on pourra aussi l'utiliser pour faire une analyse quantitative Cordialement -

D’où vient ce rayon bleu sur les photos ?

keymlinux a répondu à un sujet de Jahqo dans Support débutants

Bonjour, Je souhaite voir un dark unitaire (en fichier fit) pas un empilement, c'est parce que je veux les données issues du capteur, pas celles issues d'un calcul à postériori. De plus un dark cela se fait sans dématricage (un dématricage cela fait des calculs pour fournir les valeurs manquantes pour 2 canaux sur 3 pour chaque pixels) Pareil pour une image "light", pas d'empilement, il faut une brute unitaire. Pour les PNG c'est trop tard, cela a enregistré des fichiers en 8 bits, la perte d'information est irréversible Dans siril il faut passer par l'onglet "alignement" pour faire cette étape avant de passer à l'étape "empilement" Dans l'onglet "conversion" tu convertit des raw en fit avec création de séquence (si les fichiers sont déjà en fit cela créé juste la séquence) Ensuite pour les "bias" et "dark" tu passe directement à l'empilement, il n'y a pas de calibration ni d'alignement (vu qu'il n'y a pas d'étoiles), et l'empilement se fait sans normalisation Pour les "light", étapes conversion, puis calibration (avec le master dark) (le calibrage se fait sur les images non dématricées, cocher l'option dématricage avant la sauvegarde , puis alignement, puis empilement (normalisation additive) Tu noteras que l'on utilise pas les fichiers bias, utiles seulement si il y a des flats. Enlever les bias aux light et aux dark c'est inutile Arithmétiquement: (light - bias) - (dark -bias) = light - dark Si on a des flats cela fait: ((light - bias) - (dark -bias)) / (flat -bias) = (light - dark) / (flat - bias) Donc seuls les flats sont calibrés avec les bias -

Non, celui ci je le reconnais, c'est un modèle Klingon...