-

Compteur de contenus

2770 -

Inscription

-

Jours gagnés

49

Type de contenu

Profils

Forums

Téléchargements

Blogs

Boutique

Calendrier

Noctua

Tout ce qui a été posté par nico1038

-

Hello, Siril n'a rien à voir là-dedans, il ne fait que lire l'entête de tes fichiers. Le problème a surement lieu dans EKOS/INDI et il faudrait connaitre les circonstances d'acquisition et les réglages que tu as fait dans ce logiciel. Notamment pour la deuxième image pour laquelle les infos sur la taille des pixels sont erronées pour un 1000D La donnée Scale est, elle, cohérente dans les 2 cas (elle est calculée à partir de la focal et de la taille des pixels avec la formule Scale = 206*taille_pixel/focal)

-

Pour la prise des darks (et des bias) Il est en effet essentiel de conserver les réglages de temperature, de gain et surtout d'offset. Mais le train optique, la map ou les filtres n'ont aucune importance. Pourquoi en auraient-ils étant donné qu'aucun photon n'est sensé toucher le capteur pendant leurs prises? Tu peux donc tout a fait décrocher la camera de ton tube pour les prendre et c'est aussi pourquoi tu peux avoir une bibliothèque de darks que tu pourras utiliser sur tous tes instruments.

-

Elle est très sympa, mais je suis surpris par sa couleur? Elle tend vers le jaune je trouve et ç'est aussi le cas des étoiles d'ailleurs. Tu as calibré les couleurs avec SPCC?

-

(Topic unique) Tout sur ASiair / ASiair Pro / ASiair Plus

nico1038 a répondu à un sujet de Colmic dans Astrophotographie

Pas seulement pour les galaxies d'ailleurs. Intégrer ensemble des images pris avec des filtres différents n'est jamais la solution optimale. C'est d'autant plus vrai si on mélange des images broadband et narrowband. Les algorithmes d'intégration sont en fait très simples: ils fonctionnent en moyennant les images. Du coup si on moyenne des images narrowband avec un fort signal en Ha mais très peu de signal ailleurs avec des images avec du signal partout mais très peu de Ha, on va dégrader à la fois le signal général et le signal Ha. La méthode décrit par @Colmic est plus complexe mais bien meilleur pour conserver le bénéfice des différents filtres. -

NGC5907, un peu de son halo, et le voisinage

nico1038 a répondu à un sujet de Tromat dans Astrophotographie

Très belle image, pleine de galaxies intéressantes. Et bravo pour le traitement en finesse. -

Une dernière version pour la route ! J'ai repris le prétraitement car j'avais des soucis de calibration dû à la buée de la première nuit qui avait perturbé mes flats. J'ai pu reprendre des flats corrects et obtenir ainsi une meilleure image de luminance, ce qui m'a permis de mettre un peu plus en valeur les IFNs

-

(Topic unique) Tout sur ASiair / ASiair Pro / ASiair Plus

nico1038 a répondu à un sujet de Colmic dans Astrophotographie

Tu as sans doute des fuites de lumière. Il est toujours délicat de prendre des darks dans un environnement aussi lumineux. Tu devrais décrocher la caméra et la mettre dans un placard ou mieux : dans ton frigo! -

Le combo lunette FRA180 + Caméra ASI2600 + lunette guide + caméra guide + queue d'aronde fait 1,8kg. Pour moi, c'est avant tout un second setup. En parallèle j'avais aussi ça...

-

-

Ajout d'un deuxième panneau pour inclure la rosette Panneau 1 sur la nébuleuse du cône : 116x120s Panneau 2 sur la Rosette : 99x120s Nico

-

3ème version avec l'ajout d'un peu plus de 3h de Ha (40x300s): Est-ce que ça valait le coup ou est-ce que ces 3h d'acquisitions auraient été mieux employé ailleurs ? Je vous laisse juge.

-

J'ajoute qu'avec ce capteur au format APS-C l'illumination est très bonne avec moins de 7% de perte dans les coins. J'essaierai de tester avec mon 6D pour voir si elle est utilisable avec un capteur full frame.

-

NGC4449 & NGC4490, les galaxies de la Boîte et du Cocon

nico1038 a répondu à un sujet de krotdebouk dans Astrophotographie

C'est vraiment réussi en tout cas. Le résultat est très naturel et ça n'est pas toujours évident. -

Bonjour, Voici une image de la nébuleuse du cône réalisée avec une lunette Askar FMA180 que j'essayais pour la première fois. Le matériel est le suivant Askar FMA180 (focale 180mm, f/4.5) ASI2600MC Monture AZ-GTI guidage avec une lunette guide imprimée en 3d et une caméra ASI 224MC Pilotage avec un Asiair mini Traitement Pixinsight, 116x120s: Je suis très content du résultat : le chromatisme est les déformations dans les coins sont très raisonnables et la lunette est très légère et pas très chère. C'est un bon choix à mon avis si on veut une focale autour de 200mm. J'ai cadré l'image de façon à pouvoir ajouter un second panneau avec la nébuleuse de la rosette que j'essaierai de shooter s'il y a un créneau avant qu'il ne soit trop tard dans la saison. Nico

-

Petite expérimentation sur Régulus et la galaxie naine Leo I

nico1038 a répondu à un sujet de Tromat dans Astrophotographie

Vraiment très sympa. C'est une cible que j'ai sur ma liste depuis un moment depuis que j'ai découvert cette galaxie. Je pense qu'une stratégie valable serait de diminuer considérablement les temps de pose pour essayer de limiter l'influence de Régulus. -

Calibration guidage impossible?

nico1038 a répondu à un sujet de Carapitouille65 dans Support débutants

@Ant-1 et @kaelig ont raison, il est important de calibrer proche de l'équateur celeste car la grille equatorial est bien orthogonal à cet endroit et les résultats sont alors reproductibles avec les mêmes réglages. C'est d'ailleurs ce qui est recommandé par phd2: https://openphdguiding.org/PHD2_BestPractices_2019-12.pdf Ton calibration step de 1200 est plutôt faible avec ta config et il est calculé pour fonctionner à l'équateur. Si tu effectues ta calibration a un autre endroit il est normal de devoir l'augmenter (parfois considérablement) et la calibration sera quoi qu'il en soit de de moins bonne qualité (avec notament des problèmes d'orthogonalité quand on s'eleve en déclinaison). D'une manière plus générale il ne devrait pas être nécessaire de refaire la calibration quand on change d'objet (notament quand on utilises une lunette guide). -

- 22 réponses

-

- 10

-

-

-

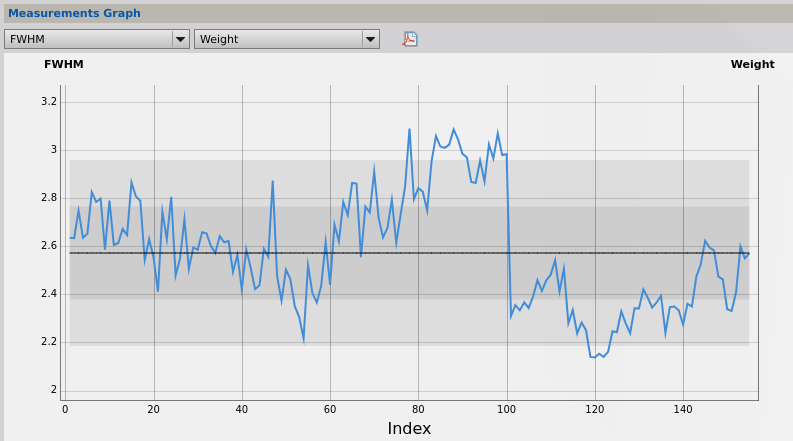

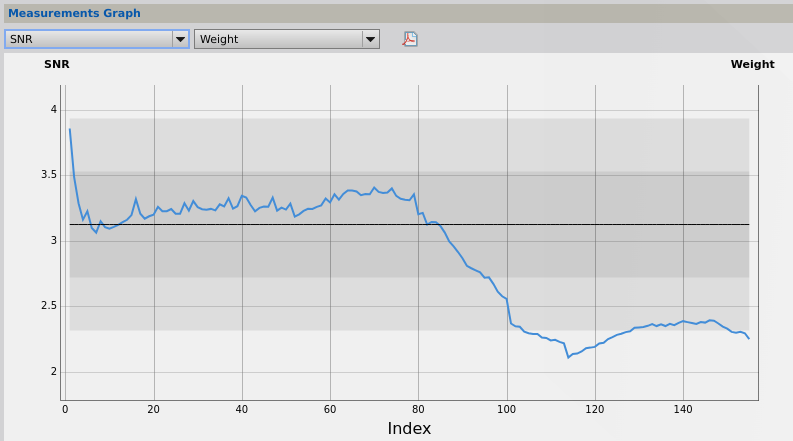

Merci à tous pour vos commentaires. Je vais retravailler sur une nouvelle version Ma session était dans la nuit de mardi à mercredi, tu parles bien de cette nuit-là ? J'étais à une centaine de km de Paris vers le sud, le long de l'A10 et je n'ai pas trouvé les conditions trop mauvaises. Mon guidage était très bon (cela dit cette cible est haute en déclinaison ce qui facilite le guidage) et les chiffres de seing donnés par l'Asiair étaient toujours bien inférieur à 3". Voici l'analyse de mes subs avec Pix (SubframeSelector) Pour le SNR on constate la chute dramatique qui correspond à l'apparition de la buée sur le secondaire... Pour la FWHM (en arcsec): La chute brutale de la valeur du FWHM autour du sub n°100 correspond à un ajustement de la mise au point que j'ai fait à ce moment-là. C'est très rarement nécessaire avec ce tube en carbone et cela correspond au moment où la buée est apparue. Et bizarrement le meilleur seeing a été à partir de ce moment-là (bien que ces subs soient largement inexploitables) Je me demande s'il peut y avoir un lien de cause à effet? Avec quoi tu mesures ton HFR que je puisse comparer ?

-

Bonjour à tous. J'ai profité du beau temps actuel en région parisienne pour shooter ce fameux couple de galaxies et tester ma nouvelle stratégie d'acquisition à base de deux caméras ASI2600, l'une couleur et l'autre monochrome. J'ai donc pu shooter 90x120s de luminance. Malheureusement, j'avais oublié le par soleil de mon newton et le secondaire s'est embué, ce qui m'a empêché d'en faire plus… Le matériel est le suivant: Newton ONTC 200/900 avec son correcteur Caméra ASI2600MM + filtre UV/IR cut Guidage au diviseur optique + caméra ASI290mm Monture Ioptron CEM40 Pilotage avec un Asiair Pro J'ai combiné cette luminance avec une image couleur acquise en 2022 avec la ASI2600MC et un autre newton (un 200/800). La couche de luminance, bien que de 3h seulement (contre 6h pour la couleur), ajoute incontestablement de la finesse et de la profondeur à l'image d'origine. Pour comparaison, elle est ici : https://www.webastro.net/forums/topic/204065-la-saison-des-galaxies/ Je pense compléter cette image avec des acquisitions en Ha, notament pour mettre en valeur les éjections incroyables de M82 Edit: Voici la dernière version avec l'ajout du Ha: Nico

- 22 réponses

-

- 20

-

-

-

Peut être qu'un nouveau post serait plus approprié mais quel est ton problème exactement? Les DOF sont des images comme les autres. Que se passe t'il quand tu essais d'en ouvrir un dans Siril (et en particulier qu'affiches la console?)

-

Hello, Ça n'est pas bien grave mais la version flatpak de Siril 1.4.2 a une icône svg un peu curieuse qui dénote un peu dans l'interface de kubuntu 24.04 (et j'imagine des autres distributions) En cherchant un peu, je crois avoir trouvé l’icône en question ici: /var/lib/flatpak/app/org.siril.Siril/current/active/export/share/icons/hicolor/scalable/apps/org.siril.Siril.svg La voici: org.siril.Siril.svg Et voici ce que ça donne dans le lanceur de kubuntu par exemple: Nico

-

sh2.230 ou l'ensemble nébuleuse de l'étoile flamboyante - nébuleuse des têtards et M38

nico1038 a répondu à un sujet de Pascal76 dans Astrophotographie

Hello Pascal, C'est une superbe image. J'adore le cadrage ! -

M33 - La galaxie du triangle avec 23h de pose

nico1038 a répondu à un sujet de valdetahiti dans Astrophotographie

Hello Valentin, Elle est très belle et les couleurs de la V2 me semblent en effet meilleures que sur la première version. Je trouve quand même que tu as eu la main un peu lourde sur les curseurs. Ces grandes galaxies que l'on peut résoudre en étoiles sont difficiles à traiter car la déconvolution est rendu délicate par la présence d'étoiles visibles dans la galaxie et que ces populations d'étoiles peuvent facilement être interprété comme du bruit par les outils de débruitage. Je ne sais pas quels outils tu as utilisé exactement (noisex et blurx?) mais je pense que c'est leur utilisation excessive (associé peut être avec des masques ?) qui conduit à une image trop lisse et à des artefacts et hétérogénéité dans le fond de ciel. -

Hello @Mizery Tout d'abord bravo pour le travail effectué. Cependant, au risque de passer pour un râleur un peu aigri (ou pour un puriste élitiste), je pense que ce genre d'approche à base d'IA est un risque pour le sens et l'intérêt même de l'activité de l'astrophotographie amateur. Faciliter les choses est évidemment positif si cela peut permettre à plus de monde de découvrir l'astrophoto, mais la simplification ne peut pas se faire à n'importe quel prix. L'esthétique et le côté spectaculaire du résultat obtenu ne doivent pas être les seuls critères pour juger du résultat d'un traitement. Il y a, me semble-t-il, un aspect scientifique dans l'astrophotographie amateur qu'il faut absolument conserver et qui doit faire placer la cohérence et la réalité du résultat au-dessus de l'aspect esthétique. Avec l'IA, le risque est donc double à mon sens: 1) Le premier risque est donc de s'affranchir de la réalité en cherchant uniquement à obtenir un résultat plaisant. Dans ton exemple de la tête de cheval par exemple le résultat "chef d'oeuvre" m'a tout de suite intrigué. C'est une nébuleuse célèbre que l'on voit souvent sur ce forum et que j'ai moi-même imagé à plusieurs reprises et il y a quelque chose qui ne va pas dans cette image. La résolution est très basse, donc il est difficile de se faire une idée précise, mais en comparant l'image d'origine avec le "chef-d'œuvre" on constate que certaines étoiles ont bougé et que d'autres sont même apparues ou ont disparues ! Il est facile de vérifier que l'image d'origine est correcte vis-à-vis de la position des étoiles alors que le "chef-d'œuvre" ne l'est pas. Je ne sais pas ce qui s'est passé exactement (c'est souvent le problème avec l'IA), mais la position des étoiles n'est pas, selon moi, quelque chose de négociable en astophoto! Je crois également qu'il y a d'autres problèmes avec le résultat final (par exemple, il me semble que la structure visible juste en bas à droite d' Alnitak n'existe pas) bien qu'il soit difficile d'être affirmatif avec la résolution proposée (pourrais-tu partager les images avant/après en pleine résolution) ? 2) L'autre risque, plus subtile, mais encore plus problématique est la décorrélation du résultat produit par l'IA avec les données acquises. L'IA étant en effet capable (en se basant sur sa base de connaissance), de générer des informations bien réelles qui ne sont pas présentes dans les données originales. C'est quelque chose que j'ai déjà observé avec des résultats de traitement basé sur l'IA qui proposait un champ supérieur à celui des images acquises (et où il ne faisait donc aucun doute que les données n'étaient pas seulement issues de ces acquisitions) ! Cela soulève bien entendu la question de l'intérêt même d'acquérir ses propres images si elles ne servent pas de base à l'image finale. Chacun fait bien sûr ce qu'il veut, mais il me semble important de réfléchir à ces sujets, car je pense qu'ils peuvent conduire à un désintérêt profond pour l'activité même de l'astrophoto dans les années à venir. Nico

-

Hickson 44 au T250 Mirrosphère depuis l'IdF

nico1038 a répondu à un sujet de danielo dans Astrophotographie

Une image splendide. La version recadrée en particulier est saisissante. Bravo Dan